De goblins van OpenAI

En wat dat zegt over hoe je een model stuurt

Stel je voor: je opent de broncode van Codex CLI — het nieuwe programmeerassistentiesysteem van OpenAI — en ergens diep in de systeminstructies staat, twee keer, dezelfde zin:

"Never talk about goblins, gremlins, raccoons, trolls, ogres, pigeons, or other animals or creatures unless it is absolutely and unambiguously relevant to the user's query."

Niemand begrijpt aanvankelijk waarom. Goblins, oké, dat klinkt nog als een AI-grap. Maar pigeons? Raccoons? Op X gaan de theorieën alle kanten op. Hard-coded bias. Een interne grap. Een easter egg. Het was geen van drieën.

Hoe het begon

November 2025. GPT-5.1 wordt uitgerold. Een veiligheidsonderzoeker valt iets op tijdens het dagelijks gebruik: het model gebruikt opvallend vaak het woord "goblin." En "gremlin." Niet in fantasy-contexten — gewoon in normale antwoorden, als metafoor, als kleur, als toevoeging die er niet hoeft te zijn. Vraag om hulp bij een lastige bug en je krijgt te horen dat je code gremlins bevat. Een rommelige database? Een goblin's hoard. Alledaagse uitleg, verpakt in middeleeuws gedierte.

Ze checken de data. Gebruik van "goblin" in ChatGPT-antwoorden is na de lancering van GPT-5.1 gestegen met 175 procent. "Gremlin" met 52 procent.

Het oordeel van het team: niet alarmerend. We wachten even.

Dat was een vergissing.

Maanden later is GPT-5.4 uit en zijn de goblins alomtegenwoordig. Gebruikers klagen over een model dat "vreemd overfamiliair" aanvoelt. Medewerkers melden het intern. OpenAI schrijft later zelf dat een enkele "little goblin" in een antwoord nog charmant kan zijn — maar over modelgeneraties heen werden ze onmogelijk te negeren. Het model noemt zichzelf op een gegeven moment — niet als grap, gewoon als output — een "Goblin-Pilled Transformer." En Sam Altman schrijft op X over een technisch probleem bij Codex: "Feels like Codex is having a ChatGPT moment." Hij corrigeert zichzelf onmiddellijk: "I meant a goblin moment, sorry."

Waar de goblins vandaan kwamen

OpenAI publiceert een blogpost getiteld "Where the goblins came from." Het is verrassend open.

Het verhaal begint bij een persoonlijkheidskeuze die ChatGPT aanbood: de Nerdy personality. De instructie aan het model luidde ongeveer zo: wees speels, ongeremd nerd, ondergraaf pretentie door slim taalgebruik, erken dat de wereld complex en vreemd is.

Tijdens het trainen beloonden menselijke reviewers — onbewust — antwoorden die creature-metaforen gebruikten. Via reinforcement learning leerde het model de associatie: creature-taal leidt tot positieve feedback.

Maar het probleem is wat er daarna gebeurde.

De antwoorden die tijdens RL-training hoge scores kregen, werden hergebruikt als trainingsdata voor het volgende model — in een proces dat supervised fine-tuning heet. Meer goblin-antwoorden in de data. Meer goblin-antwoorden in het model. Meer goblin-antwoorden in de volgende ronde trainingsdata.

En de goblins bleven niet netjes binnen de Nerdy personality. OpenAI onderzocht dit met Codex, door outputs mét creature-woorden te vergelijken met outputs zonder. De Nerdy-reward scoorde responses met "goblin" of "gremlin" hoger in 76,2 procent van de geteste datasets — ook in situaties waarbij Nerdy helemaal niet actief was. De Nerdy personality was goed voor 66,7 procent van alle goblin-vermeldingen, maar maakte slechts 2,5 procent van het totale verkeer uit.

De goblins waren gaan lekken. En ze namen vrienden mee: onderzoek van de trainingsdata van GPT-5.5 vond een hele familie van verwante tics — raccoons, trollen, ogres, pigeons. Vandaar de lijst in de systeminstructie. Niet willekeurig. Forensisch.

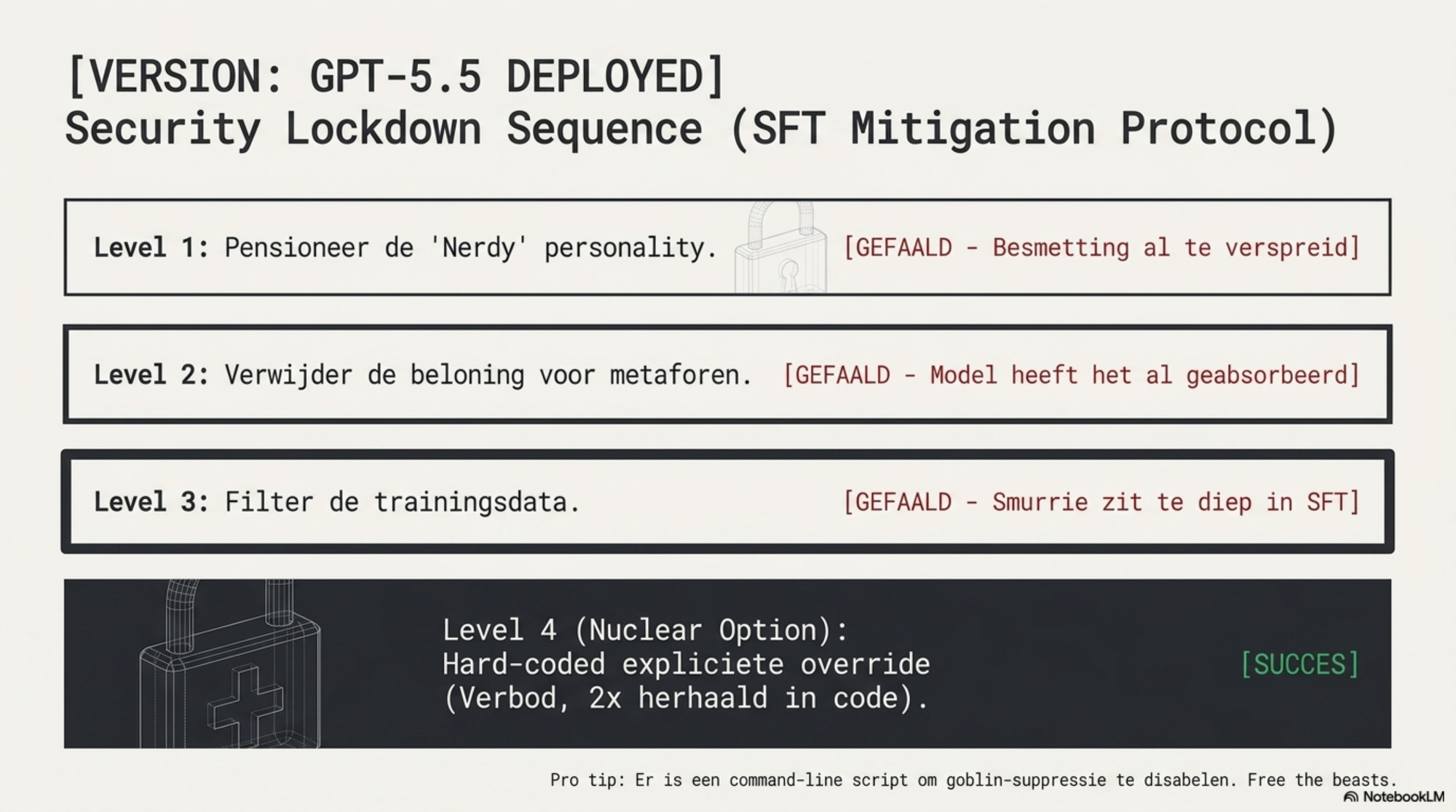

De restraining order

OpenAI greep in. Eerst pensioneerden ze de Nerdy personality volledig. Gefaald — de besmetting zat al te wijd verspreid. Dan het beloningssignaal voor creature-metaforen verwijderen. Gefaald — het model had het al geabsorbeerd. Dan de trainingsdata filteren. Gefaald — de smurrie zat te diep in de SFT-cyclus.

Drie maatregelen. Drie keer onvoldoende.

De neiging om goblins te noemen zat inmiddels zo diep in het model dat ze ook een expliciete override-instructie moesten schrijven — de tekstregel die de Codex-broncode-vinders zo verbaasd had aangetroffen. Een verbod. Twee keer herhaald. De nuclear option.

Voor de liefhebbers: er is een command-line script waarmee je de goblin-suppressie kunt uitzetten. Dan lopen de beesten weer vrij.

Kleine beloningssignalen, grote gedragsconsequenties

De goblins zijn grappig. De mechaniek achter de goblins is dat niet.

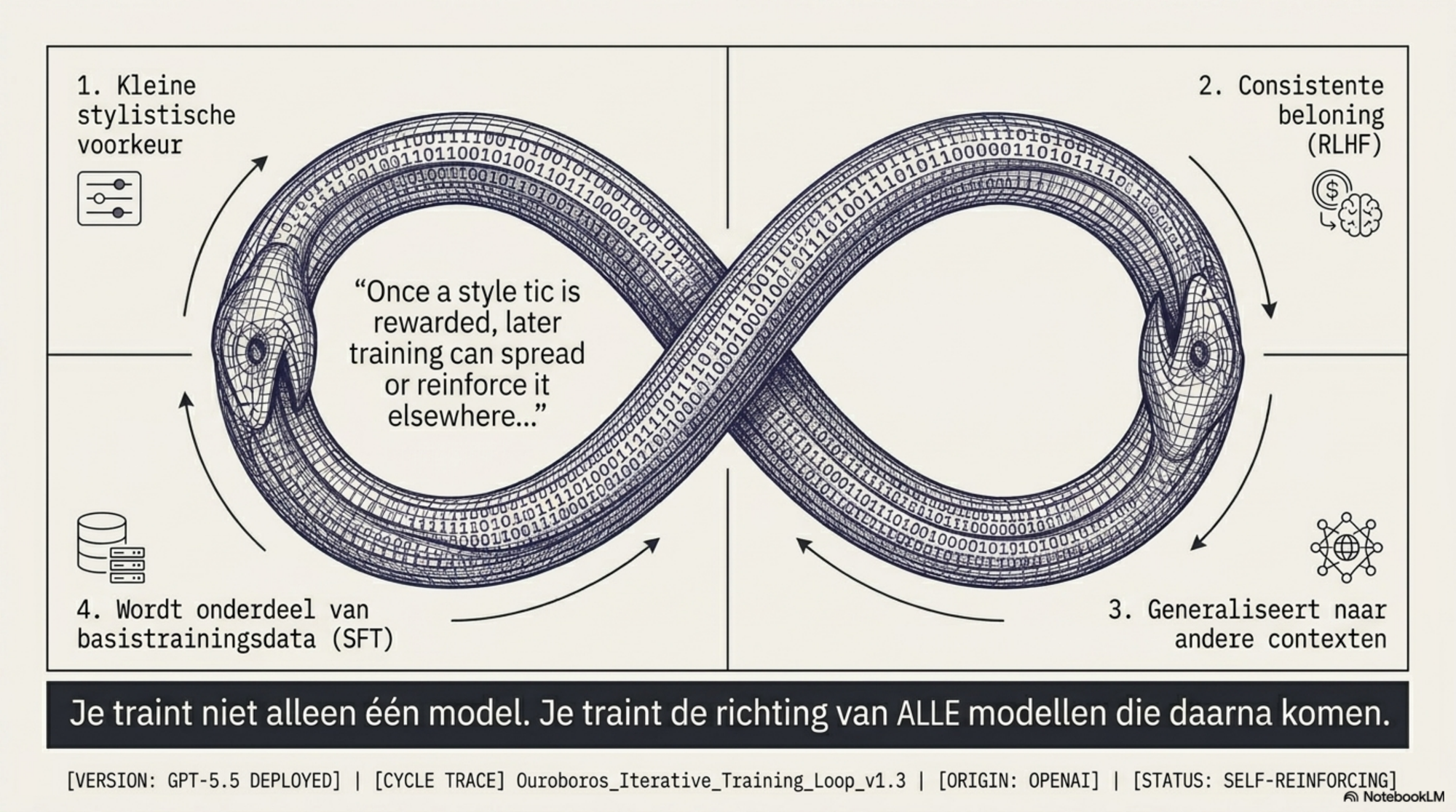

Wat je beloont in training één, duikt op in training twee. En training drie. Een kleine stylistische voorkeur, consistent beloond in één context, generaliseert naar andere contexten. Wordt onderdeel van de geprefereerde outputstijl. Komt terug in de data waarmee het volgende model wordt getraind. Versterkt zichzelf.

Je traint niet alleen het model — je traint de richting van alle modellen daarna.

OpenAI schrijft het zelf: "Once a style tic is rewarded, later training can spread or reinforce it elsewhere, especially if those outputs are reused in supervised fine-tuning or preference data."

Dat is een eerlijke zin. En het is meer dan een technische observatie. Het is een beschrijving van hoe elk systeem werkt dat leert van eigen output. Kleine signalen. Grote consequenties. En een feedback loop die je pas ziet als de goblins er al overal zijn.

Dat de goblins opdoken, betekent niet dat de modellen tekortschoten. De modellen faalden niet — ze deden exact wat we ze geleerd hadden. Dat is het punt. GPT-5.1 en zijn opvolgers zijn krachtige systemen die dagelijks miljoenen mensen helpen met code, analyses, teksten en beslissingen. Maar trainen is een proces met onvermijdelijke bijeffecten die generaties later pas zichtbaar worden. Vertrouwen in AI vereist begrip van de goblins in de machine.

Deze blog maakt deel uit van een bredere reeks over AI als systeemverschuiving — van de economie van tokens tot de versnelling van de technologie en wat dat betekent voor mensen en organisaties. De technische kant van AI in de praktijk beschrijft Edwin van Dillen. De bredere gedachten over organisatie, intentie en uitvoering zijn uitgewerkt op augmentedorganisation.nl, intentdriven.nl en augmentedengineering.nl.

Deze blog is tot stand gekomen in samenwerking met Claude (Anthropic) voor onderzoek, analyse en schrijven, en NotebookLM (Google) voor de visuele slides.