Tokens op de meter

Waarom AI weinig lijkt te kosten — en waarom dat gaat veranderen

Op 11 maart 2026 sprak Sam Altman op de BlackRock Infrastructure Summit in Washington. Zijn woorden resoneerden bij mij — niet omdat ze verrassend waren, maar omdat de kostprijs van AI mij al een tijdje bezighoudt, terwijl het onderwerp in de mainstream nog maar beperkt besproken wordt.

Altman zei: "Fundamentally our business and I think the business of every other model provider is going to look like selling tokens."

En even later: "We see a future where intelligence is a utility like electricity or water and people buy it from us on a meter."

Dat is geen marketingtaal. Dat is een heldere beschrijving van een businessmodel. Altman maakt met zijn woorden duidelijk hoe de AI-industrie werkt en hoe hij verwacht dat die zich verder ontwikkelt. Tokens zijn de munteenheid. Jij bent de afnemer. En de toekomst ziet eruit als een nutsrekening.

De vraag die je jezelf moet stellen is niet of je dat erg vindt. De vraag is: begrijp je wat dit betekent?

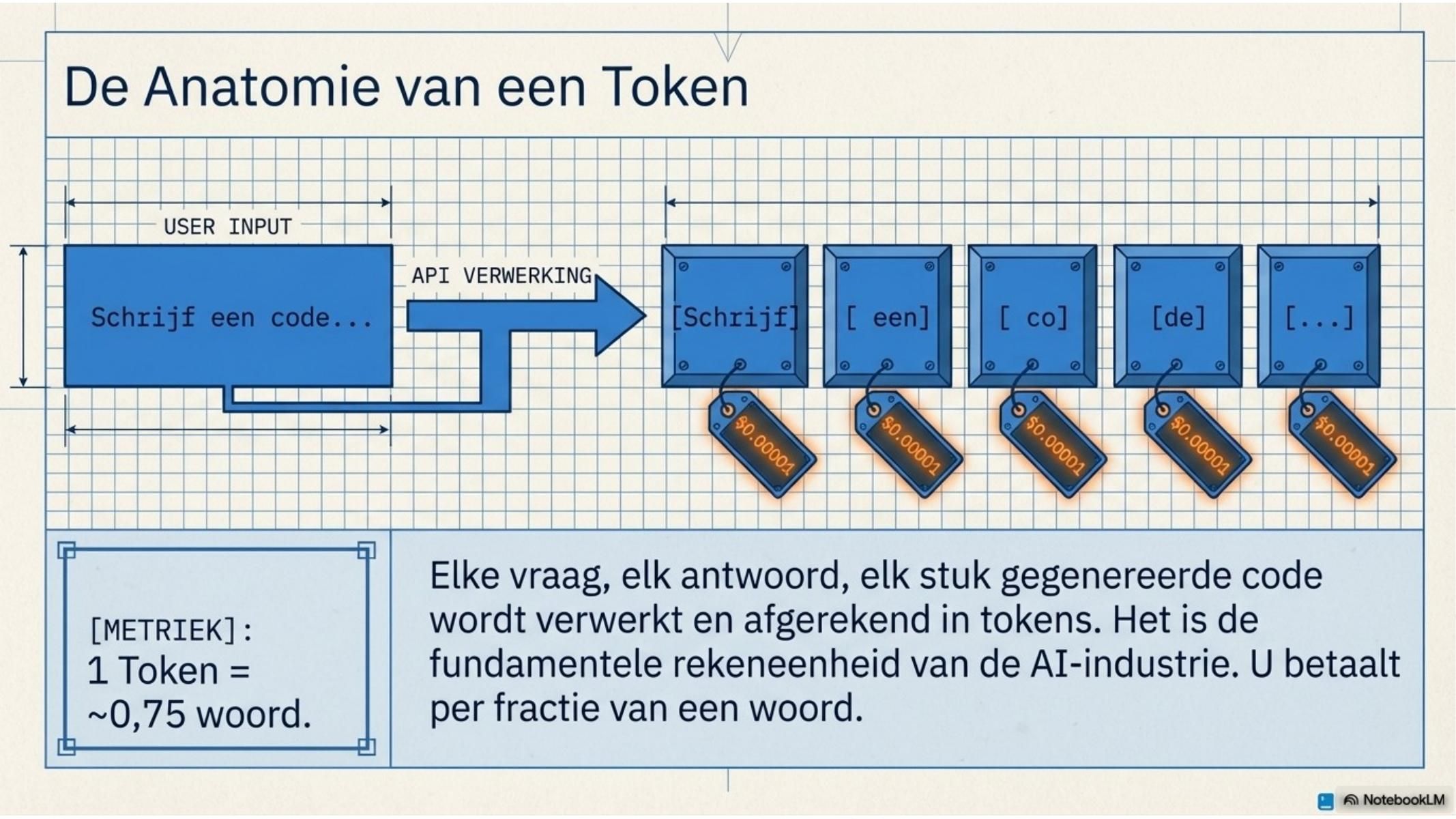

Wat is een token — en waarom zou je dat moeten weten

Elke grote AI-aanbieder verkoopt in de kern hetzelfde product: tokens. Een token is de fundamentele rekeneenheid waarmee een taalmodel werkt — ruwweg driekwart woord. Elke vraag die je stelt, elk antwoord dat je terugkrijgt, elke samenvatting, elk gegenereerd stuk code: het wordt verwerkt en afgerekend in tokens. Dat is de onderliggende transactie, of je je dat bewust bent of niet.

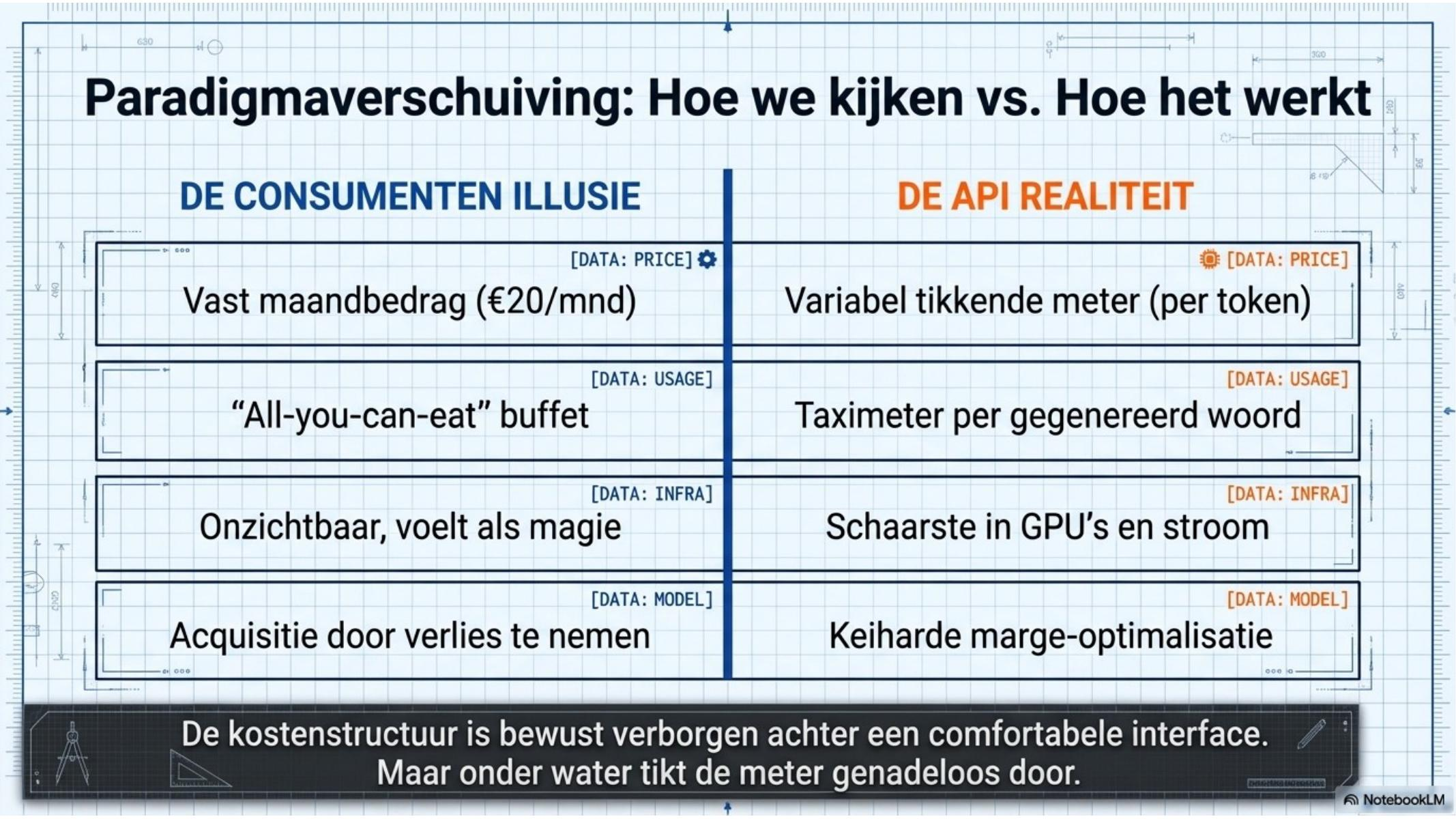

De meeste mensen realiseren zich dit niet. Ze tikken iets in, ze krijgen antwoord. Ze betalen een vast maandbedrag van twintig euro, of helemaal niets. Het voelt niet als verbruik. Het voelt niet als een meter die tikt.

Maar hij tikt wel. En Altman maakt met zijn woorden duidelijk dat dat de kern is van zijn businessmodel.

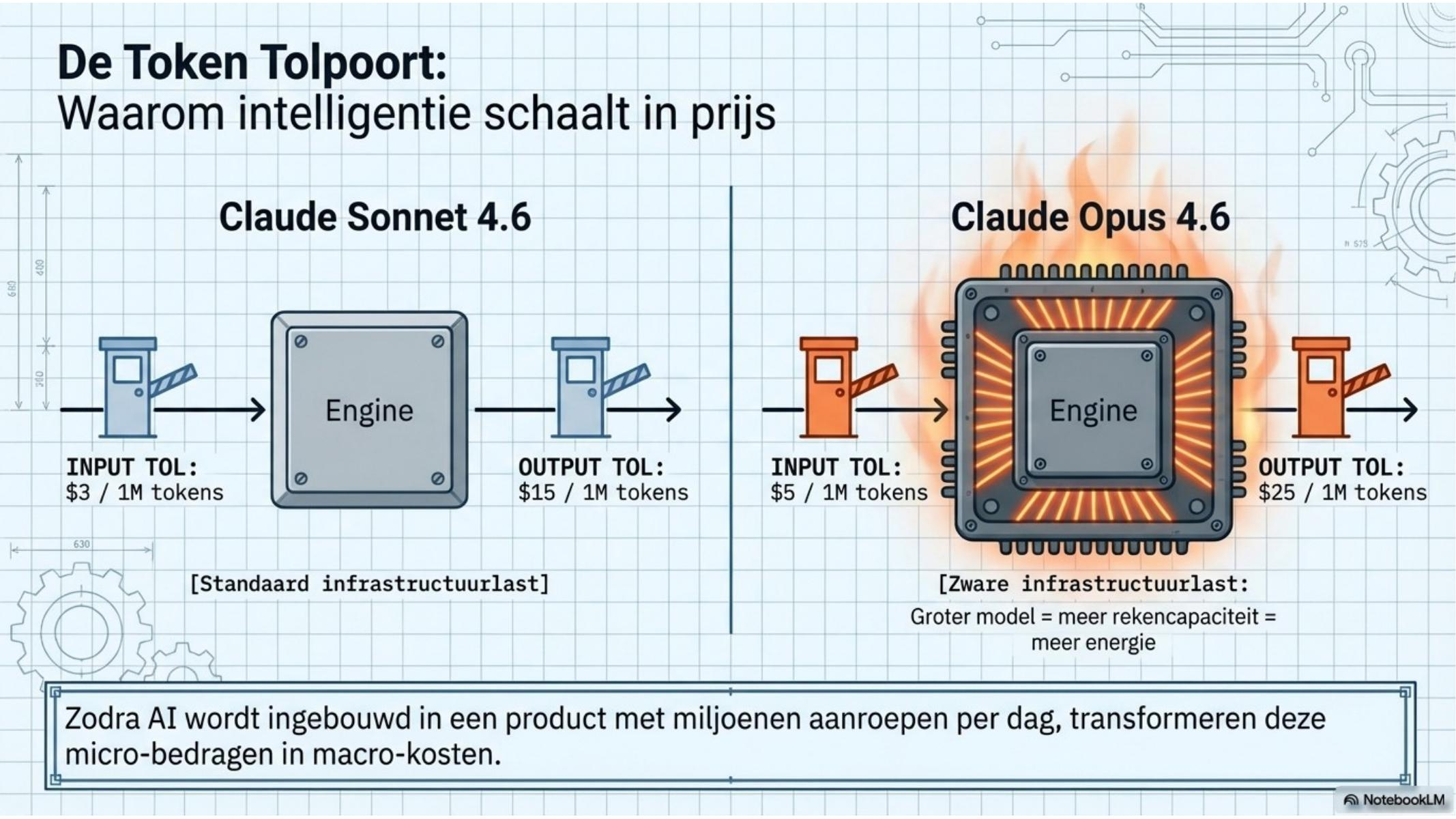

Om het concreet te maken: de API-prijs van Anthropic's modellen — de prijs die developers betalen als ze AI direct in hun producten integreren — bedraagt momenteel voor Claude Sonnet 4.6 drie dollar per miljoen input tokens en vijftien dollar per miljoen output tokens. Voor Claude Opus 4.6, het zwaardere model, is dat vijf dollar input en vijfentwintig dollar output per miljoen tokens. Opus is duurder omdat het model fundamenteel groter is, meer rekencapaciteit vraagt per aanroep en daarmee ook meer energie verbruikt per antwoord. Hoe capabeler het model, hoe zwaarder de infrastructuurlast per token.

Voor een individuele gebruiker lijken deze bedragen klein. Maar zodra je AI inbouwt in een product dat duizenden of miljoenen aanroepen per dag doet, tellen die tokens snel op.

Dat is precies waarom ik dit schrijf.

De verslavingsfase

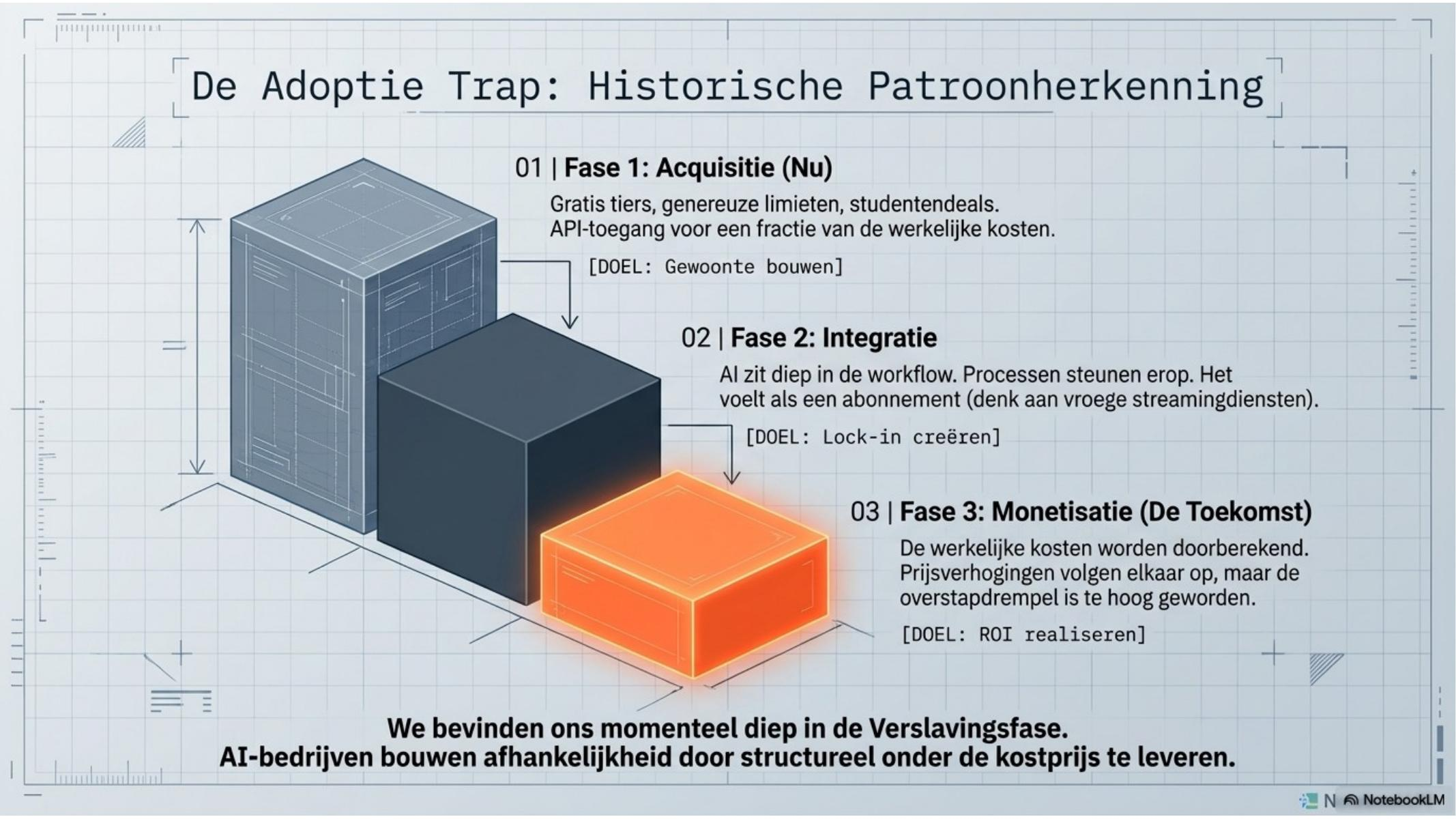

We zitten nu in wat ik de verslavingsfase noem.

AI-bedrijven geven weg. Ze geven veel weg. Gratis tiers, genereuze limieten, aanbiedingen voor studenten en startups, API-toegang voor een fractie van de werkelijke kosten. Ze bouwen gewoonte. Ze bouwen afhankelijkheid. Ze bouwen lock-in.

Dit is geen liefdadigheid — dit is een bewuste businessstrategie die we kennen uit andere technologiegolven. Denk aan de eerste maand gratis internet. Cloudopslag dat ooit gratis was tot iedereen zijn foto's, bestanden en herinneringen erin had staan. Streamingdiensten die jarenlang zo goedkoop waren dat je je er nauwelijks bewust van was totdat drie prijsverhogingen later het maandbedrag plotseling verdubbeld bleek.

Je raakt gewend. Je integreert het in je workflow. Je bouwt er processen omheen. Je vertrouwt erop. En op het moment dat de prijs stijgt, is de overstapdrempel al hoog genoeg dat je niet meer weg gaat.

Individuen doen dit. Organisaties doen dit. Ik doe dit. En de meesten doen het zonder ook maar één seconde na te denken over wat het eigenlijk kost — want de kostenstructuur is met opzet verborgen achter een comfortabel abonnementsmodel of een ogenschijnlijk gratis interface.

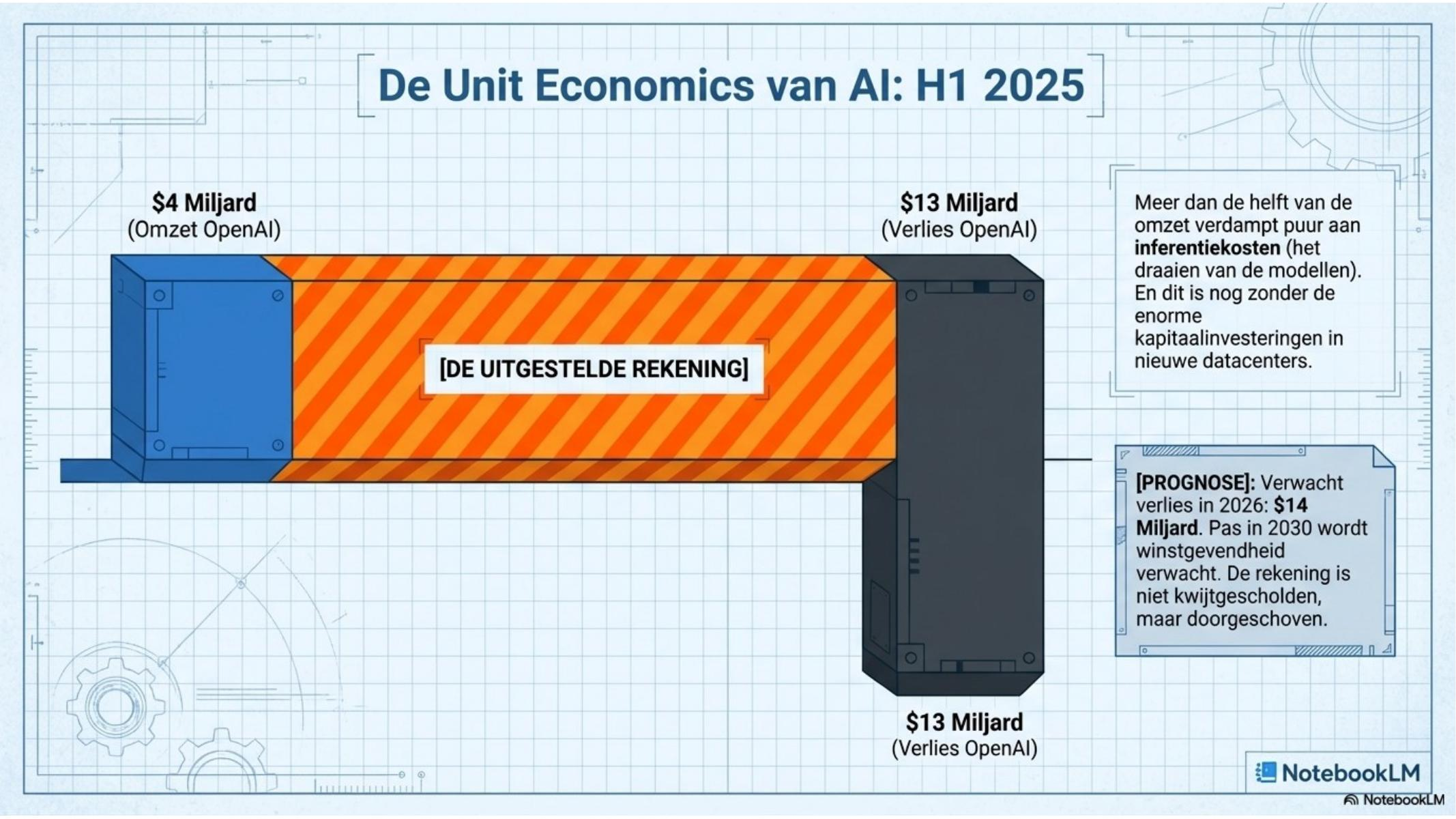

Maar er is iets wat de meeste mensen niet weten: de prijs die je nu betaalt, dekt de werkelijke kosten niet. Uit de financiële cijfers van OpenAI blijkt dat het bedrijf in de eerste helft van 2025 ruim vier miljard dollar omzet genereerde en tegelijkertijd dertien miljard dollar verlies boekte. De inferentiekosten alleen al — het simpelweg draaien van de modellen — namen meer dan de helft van de omzet in beslag. De enorme kapitaalinvesteringen in datacenters, GPU-clusters, modeltraining en onderzoek zitten er nauwelijks in verdisconteerd. Die rekening is uitgesteld, niet kwijtgescholden.

De economische rekening

En die uitgestelde rekening is groot.

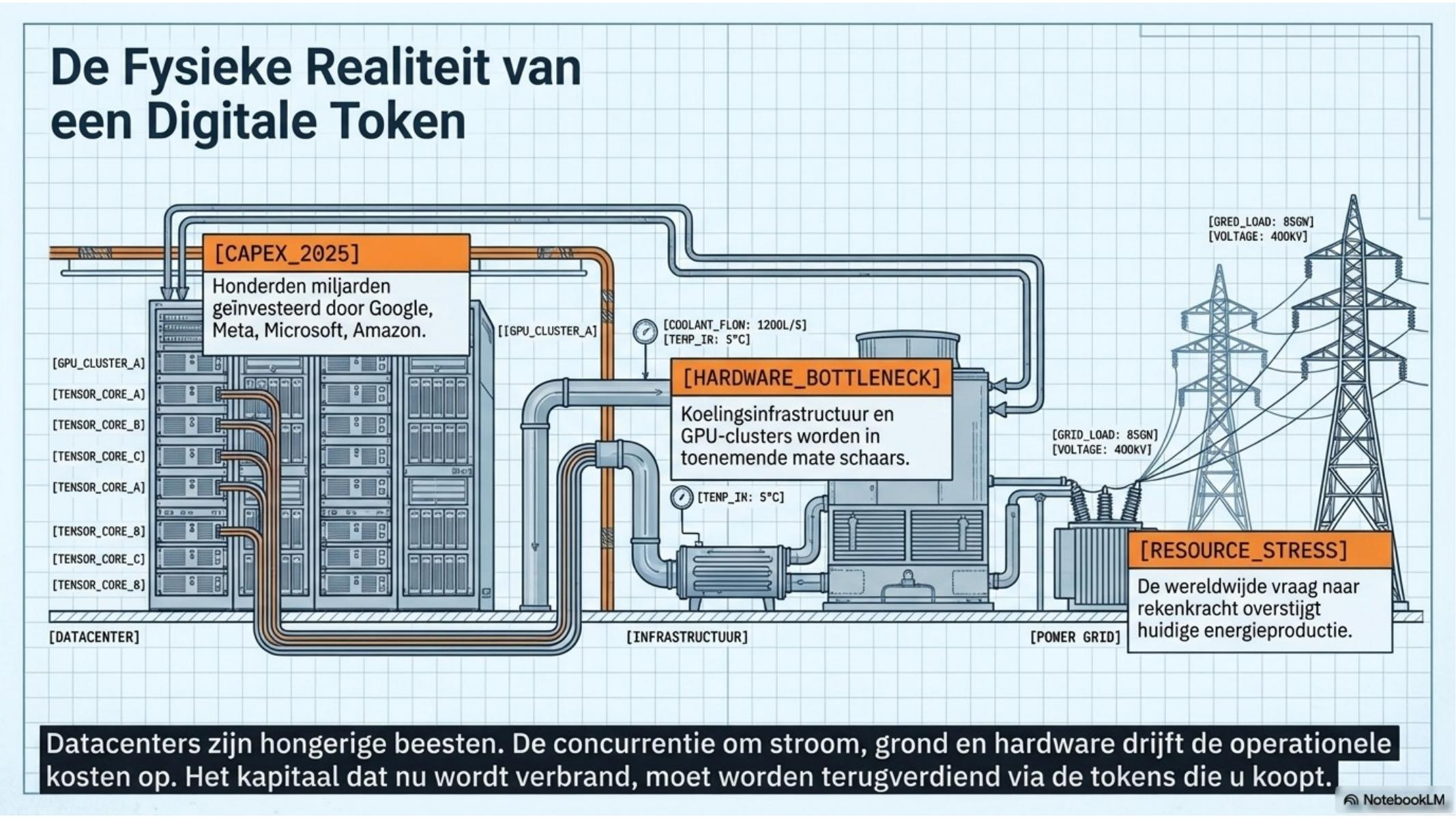

Google, Microsoft, Meta, Amazon — zij pompen in 2025 samen honderden miljarden in datacenters, GPU-clusters en energieinfrastructuur. OpenAI verwacht in 2026 veertien miljard dollar verlies te draaien en pas in 2030 winstgevend te worden. Allemaal met één impliciete belofte aan investeerders: dit geld komt ooit terug.

Dat kapitaal moet worden terugverdiend. En dat kan maar op één manier: via de tokens die ze verkopen.

Er is nog een tweede factor. Datacenters zijn hongerige beesten. De vraag naar rekenkracht groeit sneller dan de energieproductie bijhoudt. Koelingsinfrastructuur wordt schaars. De concurrentie om stroom, grond en hardware drijft de operationele kosten op. Efficiency-winsten door betere architectuur en kleinere modellen kopen tijd, maar lossen de onderliggende vergelijking niet op.

Het is altijd de eindgebruiker die de rekening betaalt. De investeerders in Jensen Huang's GPU-fabrieken gaan die factuur niet zelf voldoen. Wij betalen hem — als individuen en als organisaties.

De afhankelijkheidsval

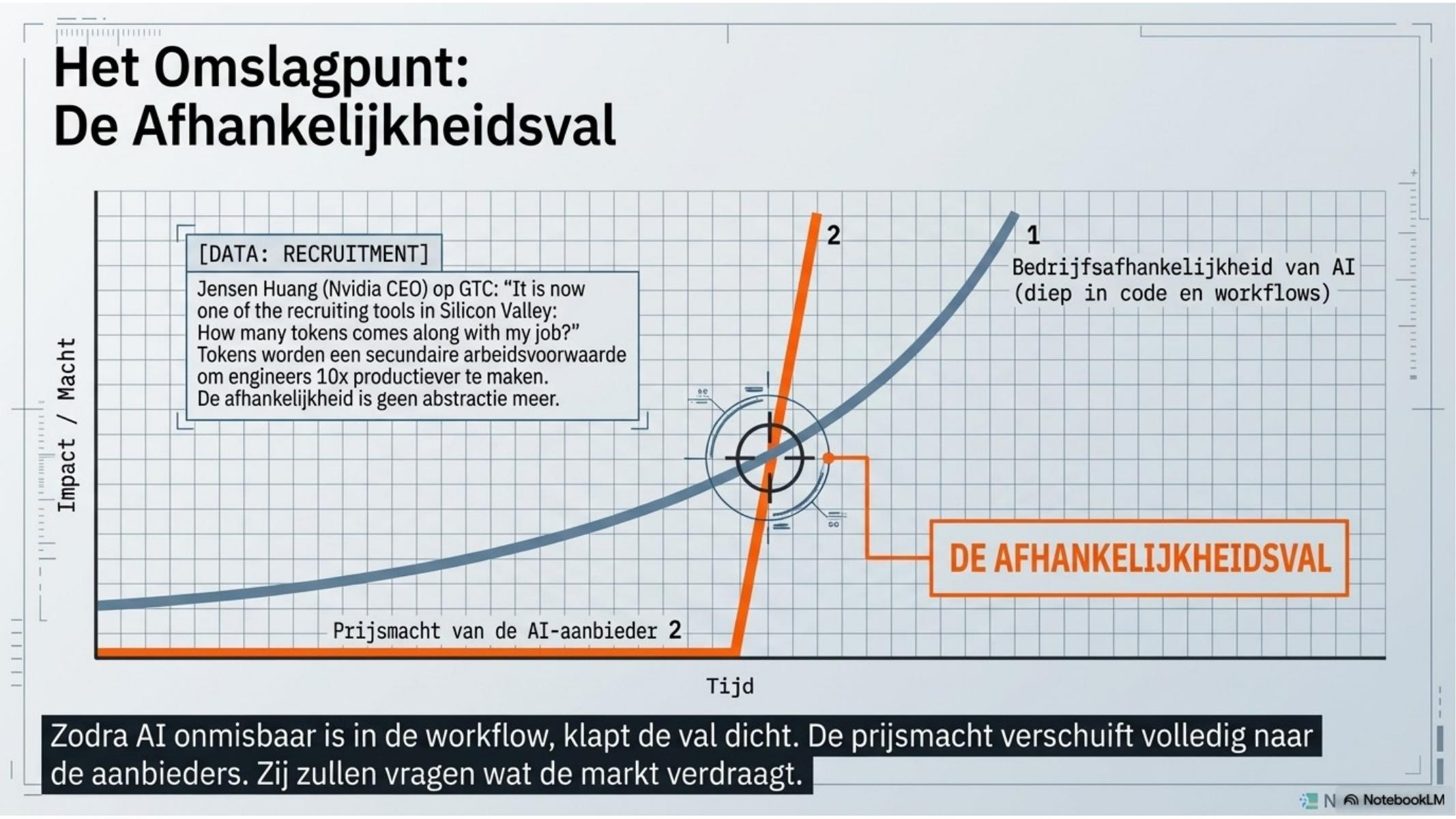

En hier wordt het pas echt interessant. Want het moment waarop de prijzen serieus stijgen, zijn we er al volledig van afhankelijk.

AI zit dan ingebakken in onze workflows. In de codeeromgeving van de developer, de tekstverwerking van de marketeer, de analyse van de consultant, de klantenservice van het bedrijf, de besluitvorming van de manager. Het is niet meer iets wat je gebruikt — het is iets waar je op leunt. Iets wat je niet meer wegdenkt.

Op dat moment verschuift de prijsmacht volledig naar de aanbieders. Ze vragen wat de markt verdraagt. En de markt verdraagt veel, als de alternatieven te duur of te traag zijn om serieus te nemen.

Dit patroon kennen we. We hebben het gezien met bedrijfssoftware, cloudopslag, mobiele data en professionele platformen. Het begint goedkoop, wordt onmisbaar, en dan pas gaat de prijs omhoog. Het verschil met AI is de snelheid en de diepte van de integratie. Dit gaat sneller, en de afhankelijkheid gaat dieper dan bij eerdere technologiegolven.

Hoe diep bleek vorige week maandag. Jensen Huang stond op het podium van Nvidia's GTC-conferentie in San Jose en zei iets wat bleef hangen. Hij verwacht dat engineers naast hun basissalaris ruwweg de helft daarvan bovenop krijgen in de vorm van tokens — zodat ze tien keer zo productief kunnen zijn. En: "It is now one of the recruiting tools in Silicon Valley: How many tokens comes along with my job?" Tokens als arbeidsvoorwaarde. Tokens als recruteringstool. Huang heeft er overigens alle belang bij dat de vraag naar tokens stijgt — hij verkoopt de chips die ze produceren. Maar dat maakt zijn observatie niet minder waar. De afhankelijkheid is geen abstractie meer.

Ik schrijf dit niet om angst te zaaien. Ik schrijf het omdat ik denk dat er een vaardigheid is die je nu kunt bouwen — en die straks aanzienlijk meer waard is dan hij vandaag lijkt.

Token-efficiëntie als strategische vaardigheid

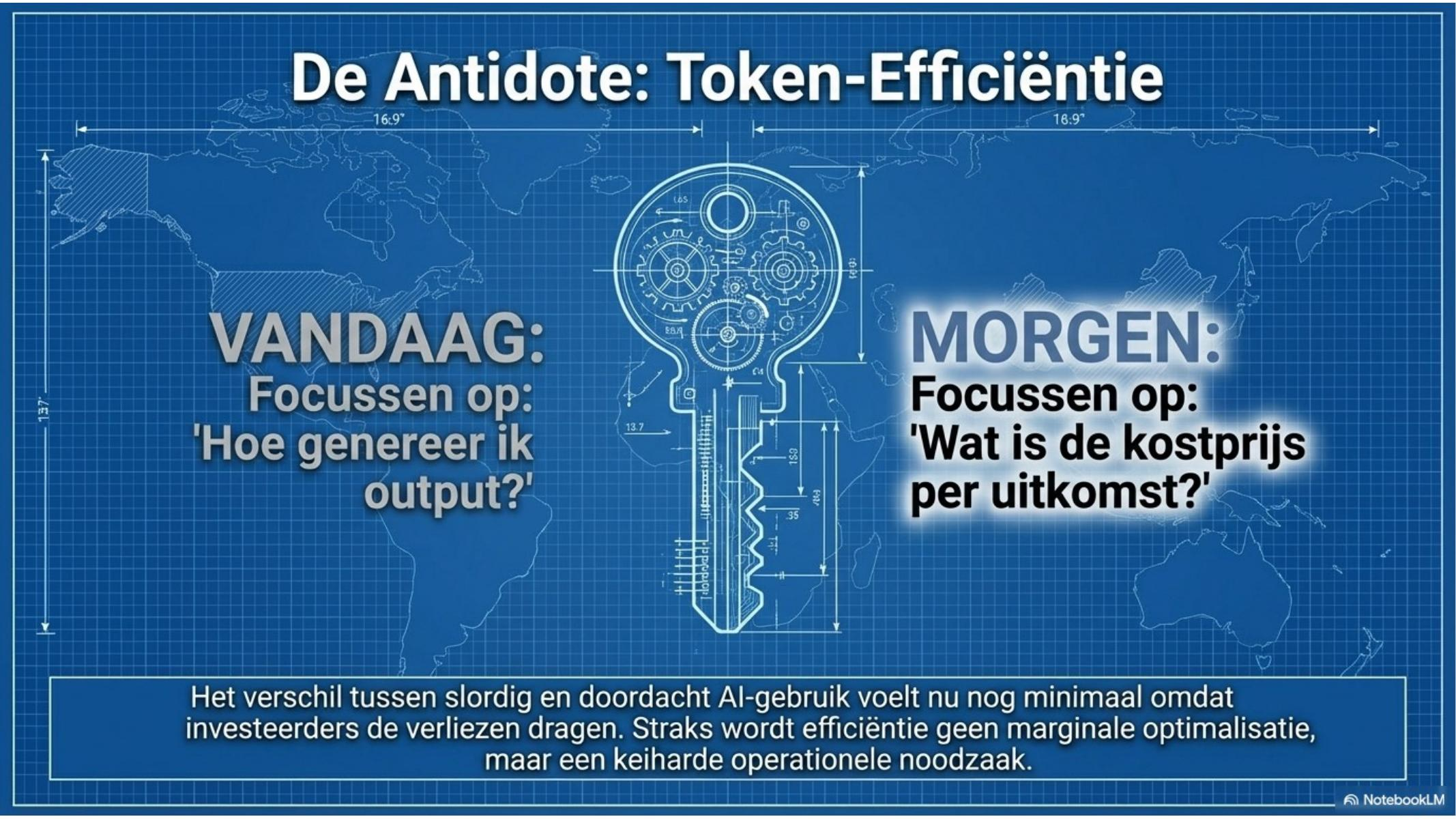

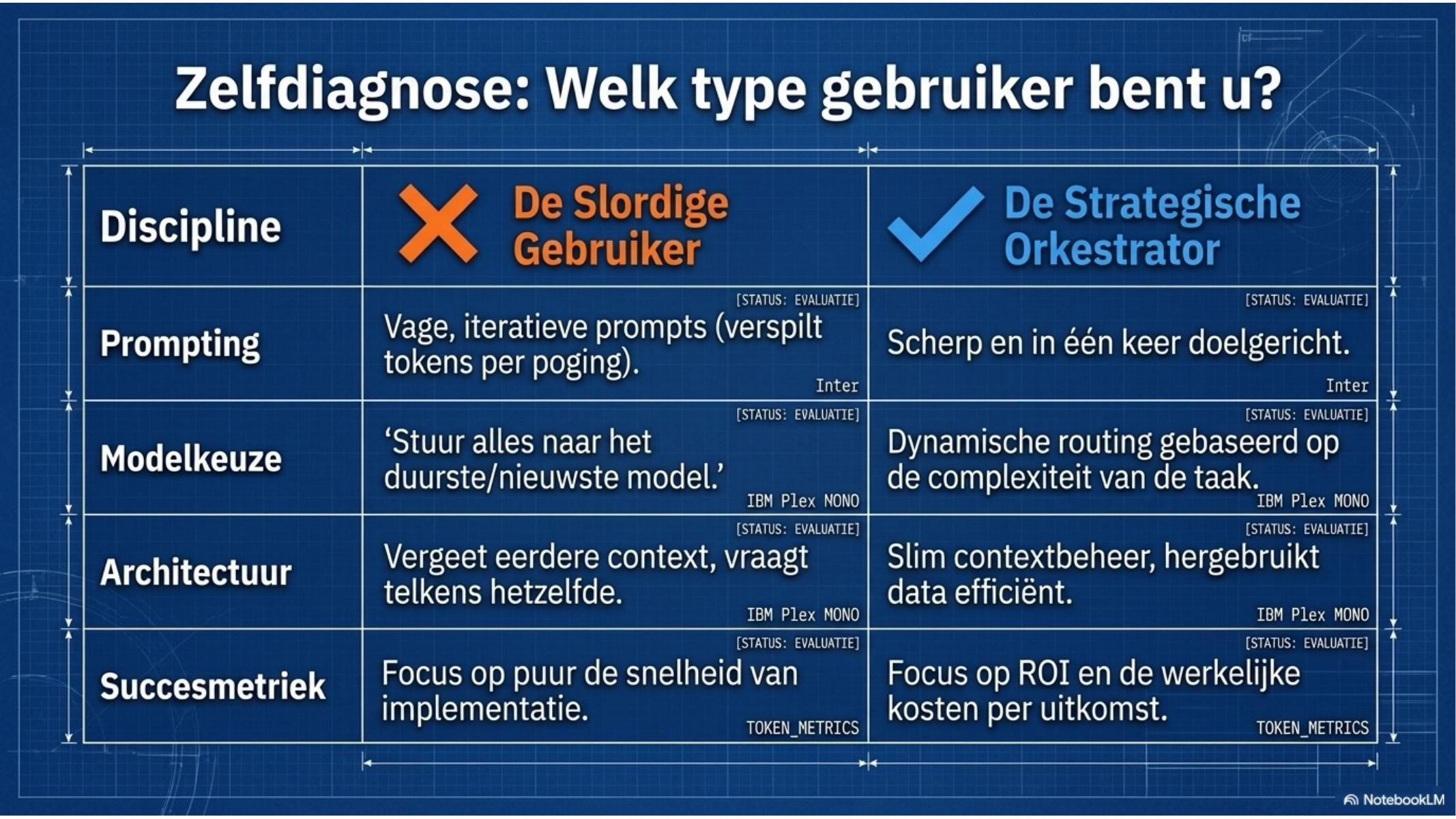

De mensen die nu al nadenken over token-efficiëntie zijn een kleine groep: developers die per API-aanroep betalen, teams die AI diep in producten hebben geïntegreerd, en een handvol early adopters die de kostenstructuur van taalmodellen begrijpen.

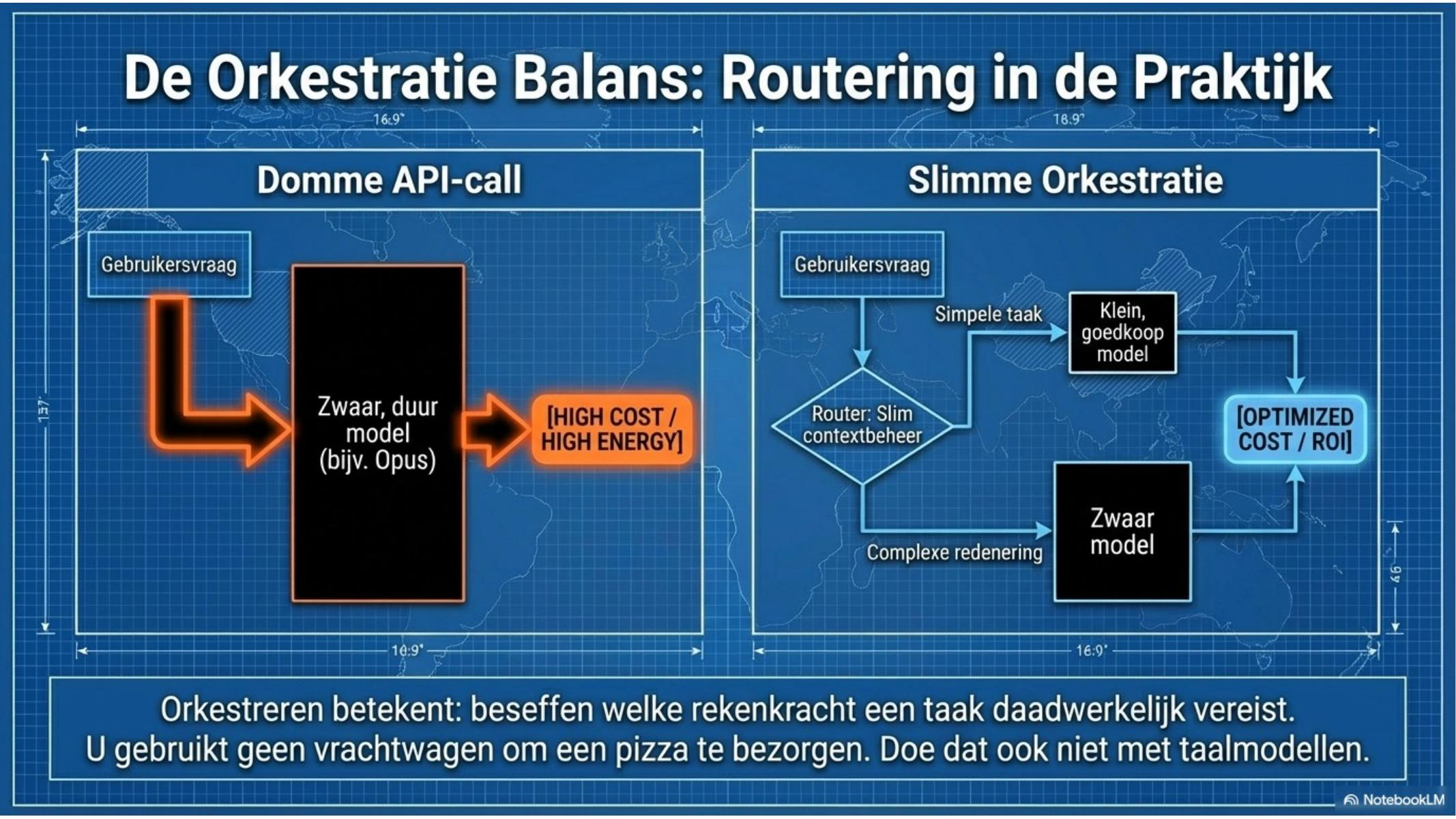

Zij schrijven over het verschil tussen een vage prompt en een scherpe. Ze denken na over architectuurkeuzes: welke taken zijn de rekenkracht van een groot model waard, en welke kun je afdoen met een kleiner, goedkoper alternatief? Ze bouwen systemen die context slim beheren zodat je niet telkens opnieuw het wiel uitvindt. Ze denken in kosten per uitkomst, niet in kosten per abonnement.

Dat is nog een nichevaardigheid. Maar het is de vaardigheid die straks het onderscheid maakt.

Het verschil tussen slordig en doordacht AI-gebruik is nu nog beperkt — de prijzen zijn laag, de verliezen worden gedragen door investeerders. Maar dat verandert. Meer gebruik betekent meer tokens. Meer afhankelijkheid betekent minder alternatieven. En zodra de uitgestelde rekening wordt ingelost — gedreven door aandeelhouderswaarde, kapitaalkosten en een infrastructuur die zijn eigen gewicht moet gaan dragen — wordt efficiëntie geen optimalisatie meer maar een kostenpost die telt. De teams die die vaardigheid nu bouwen, hebben straks een structureel voordeel — én een dieper begrip van hoe je AI inzet om waarde te creëren in plaats van alleen output te genereren.

Dit is onderdeel van wat het betekent om een orkestrator te zijn. Niet alleen weten hoe je AI aanstuurt, maar ook begrijpen wat het kost om AI aan te sturen — en hoe je die kosten in verhouding brengt tot de waarde die je creëert.

Een zijplot: twee werelden, twee strategieën

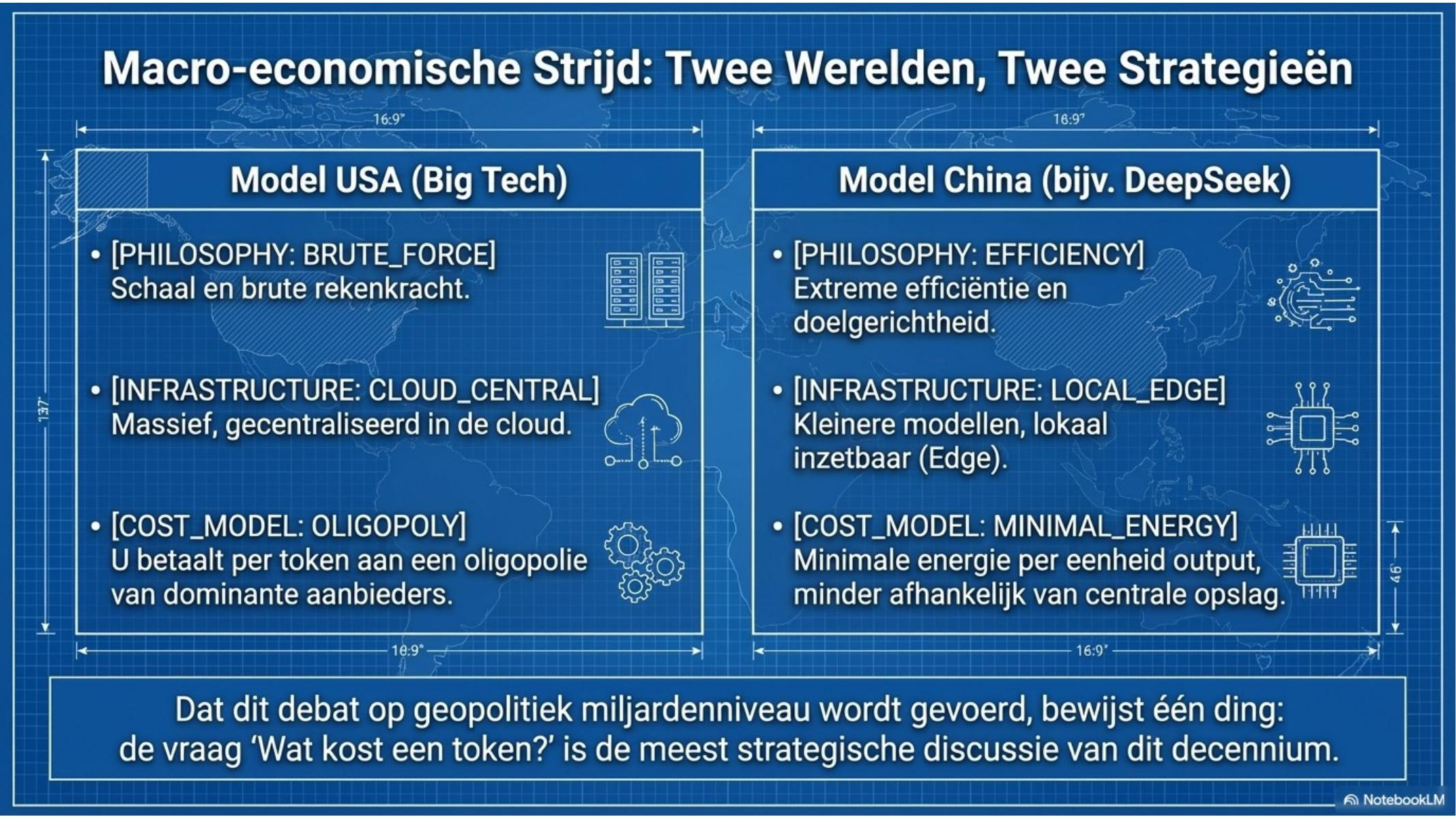

Als achtergrond is het de moeite waard om te noemen dat er twee fundamenteel verschillende betten op tafel liggen in de wereld van AI-infrastructuur.

De Amerikaanse aanpak: grote, krachtige, dure modellen. Schaal als strategie. Centrale rekenkracht. Je betaalt per token aan een paar grote aanbieders die de markt domineren. De Chinese aanpak, zoals zichtbaar in modellen als DeepSeek, gaat een andere kant op: kleinere, efficiëntere modellen. Lokaal inzetbaar. Minder afhankelijk van centrale infrastructuur. Minder energie per eenheid output.

Welke filosofie wint, weet niemand. Maar het is veelzeggend dat dit debat überhaupt bestaat op het niveau van nationale strategie en miljardenbedrijven. Het bewijst dat de vraag "wat kost een token?" al centraal staat in de meest strategische discussies van onze tijd.

Die vraag zou ook centraal moeten staan in de jouwe.

De meter tikt

Altman heeft gelijk: intelligentie wordt een nutsvoorziening. Net als stroom. Net als water. Net als je telefoonabonnement.

En net als bij stroom, water en telefoon — betaal je uiteindelijk wat het kost. De nutsbedrijven van intelligentie zijn nu bezig met het bouwen van de infrastructuur. De investeringen zijn gedaan. De afhankelijkheid groeit. De prijsmacht wordt opgebouwd.

De meter loopt al. De echte prijs wordt voorlopig nog doorgeschoven — gedragen door investeerders die wachten op hun rendement. Maar op enig moment landt die rekening gewoon bij jou en mij.

Wil je de context lezen waarin deze blog staat? Die vind je in de eerder verschenen blogs in deze reeks:

→ De Mens als Orkestrator — over hoe AI de menselijke rol verschuift van uitvoerder naar dirigent.

→ De Centaur — over hoe mens en AI als één geheel opereren, en wat dat vraagt van hoe je werkt en denkt.

→ Het Schaakbord — over exponentiële groei, waar we staan, en waarom lineaire stappen de kloof niet dichten.

Co-creatie: Dit stuk is gemaakt samen met Claude (Anthropic), versie Sonnet 4.6. De gedachten, posities en interpretaties zijn van mij. Claude heeft geholpen bij het structureren, het aanscherpen van argumenten en het schrijven van de tekst. Ik vind het bij dit onderwerp passen om dat expliciet te benoemen. NotebookLM gebruikt voor de visuals.