De Kloof

Over de groeiende afstand tussen wat AI kan en wat wij ermee doen — en de schokken die komen als we die afstand niet dichten

Co-creatie: Dit stuk is gemaakt samen met Claude (Anthropic), versie Sonnet 4.6 en NotebookLM. De gedachten, posities en interpretaties zijn van mij. Claude heeft geholpen bij het structureren, het opzoeken en verifiëren van bronnen, het aanscherpen van argumenten en het schrijven van de tekst. En NotebookLM zorgt voor de visualisaties. Ik vind het bij dit onderwerp passen om dat expliciet te benoemen.

Dit is een persoonlijk conceptgedachtenspinsel, bedoeld voor eigen reflectie en als beginpunt voor gesprek. Geen eindoordeel, geen definitief standpunt. Ik ga hier zelf verder op kauwen en gebruik het als startpunt voor gesprekken om het geheel verder aan te scherpen.

Er is iets eigenaardig aan de manier waarop wij over kunstmatige intelligentie praten. We praten erover alsof het een verre toekomst betreft, terwijl het voor een kleine groep mensen en organisaties al de dagelijkse werkelijkheid is. We praten erover alsof de afstand tussen wat AI nu kan en wat wij nu doen een gegeven is, terwijl die afstand elke maand groter wordt. En we praten erover alsof aanpassing vanzelf gaat, terwijl de geschiedenis ons keer op keer leert dat grote technologische transities niet geleidelijk verlopen maar in schokken.

Dit stuk is een poging mijn gedachten te ordenen over dat spanningsveld. Ik schrijf het in de eerste plaats voor mezelf — als ondernemer die al meer dan twintig jaar werkt aan de ontwikkeling van IT-talent en die nu ziet hoe de grond onder zijn voeten verschuift. Ik gebruik het ook als startpunt voor gesprekken.

Ik zal drie centrale stellingen onderbouwen. Ten eerste: de capability gap — de kloof tussen wat AI theoretisch kan en wat wij er daadwerkelijk mee doen — is al enorm, groter dan de meeste mensen beseffen. Ten tweede: die kloof groeit sneller dan hij gedicht wordt, omdat de technologie zich sneller ontwikkelt dan de adoptie. Ten derde: dit leidt niet tot geleidelijke aanpassing, maar tot discontinue schokken — in markten, op de arbeidsmarkt en in instituties.

I — De onzichtbare revolutie in getallen

Begin bij de feiten. In maart 2025 publiceerde METR — een onafhankelijk AI-evaluatiebureau — een studie die ik beschouw als een belangrijke meting van dit moment.

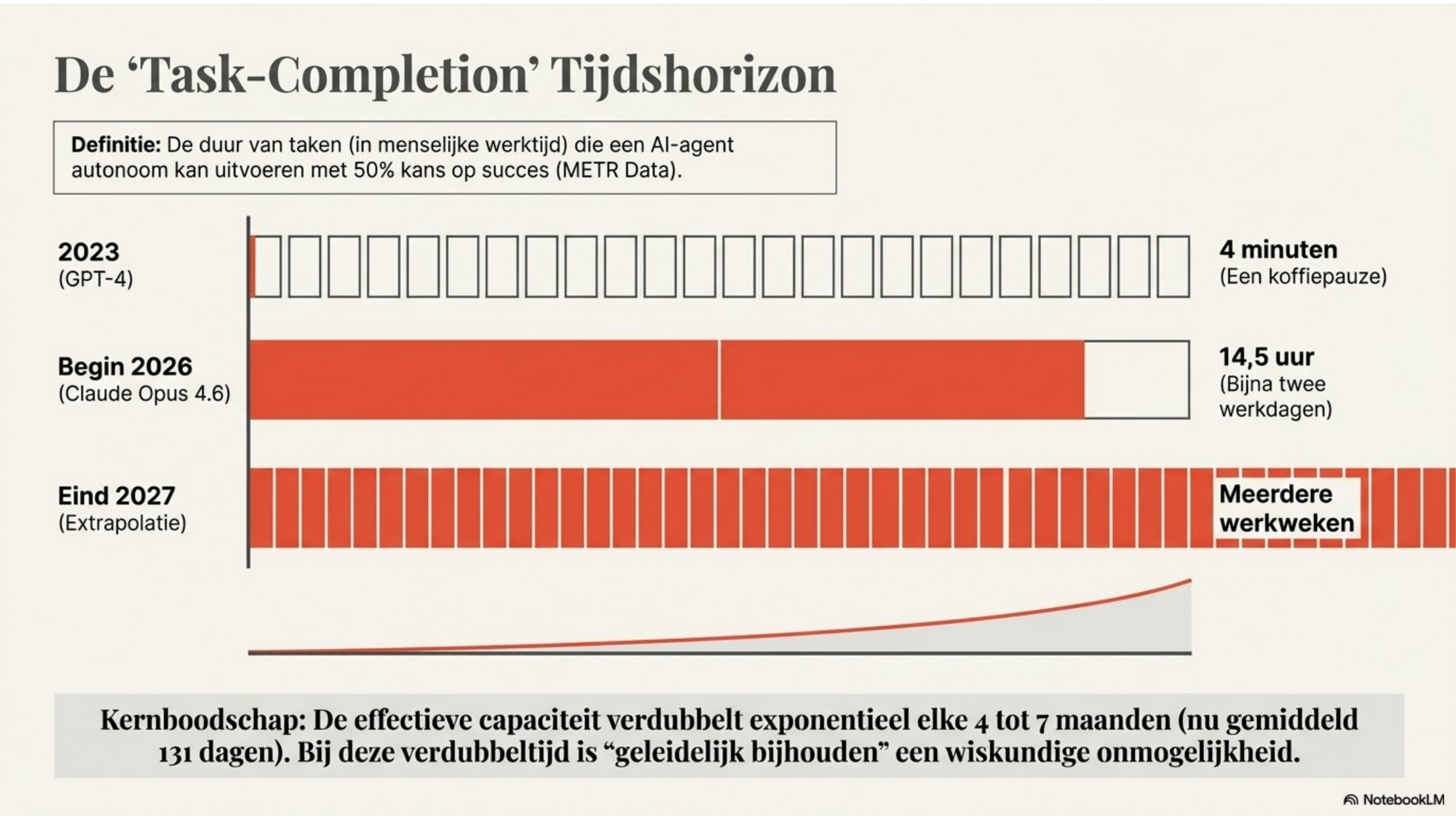

Zij introduceerden het concept van de task-completion time horizon: de duur van taken (gemeten in menselijke werktijd) die een AI-agent autonoom kan uitvoeren met vijftig procent kans op succes.[1]

De centrale bevinding: die tijdshorizon verdubbelt exponentieel. Over de gehele periode 2019–2025 bedraagt de verdubbeltijd gemiddeld zeven maanden. Gemeten over de periode na 2023 — onder de verbeterde TH1.1-methodologie — komt METR op 131 dagen, ongeveer vier maanden.[2] De meest recente officieel gepubliceerde meting, van februari 2026, plaatst Claude Opus 4.6 op een p50-tijdshorizon van circa 14,5 uur — al is de betrouwbaarheidsinterval breed (6 tot 98 uur), omdat de huidige taakset van METR bij de langere taken begint te satureren.[3]

Ter vergelijking: GPT-4, uitgebracht in 2023, had een tijdshorizon van ongeveer vier minuten. Dat is een factor van meer dan tweehonderd in circa drie jaar. Dit zijn geen marketingcijfers. Het zijn empirisch gemeten feiten, met methodologische voorbehouden die METR zelf openlijk benoemt — maar de trendlijn is robuust.

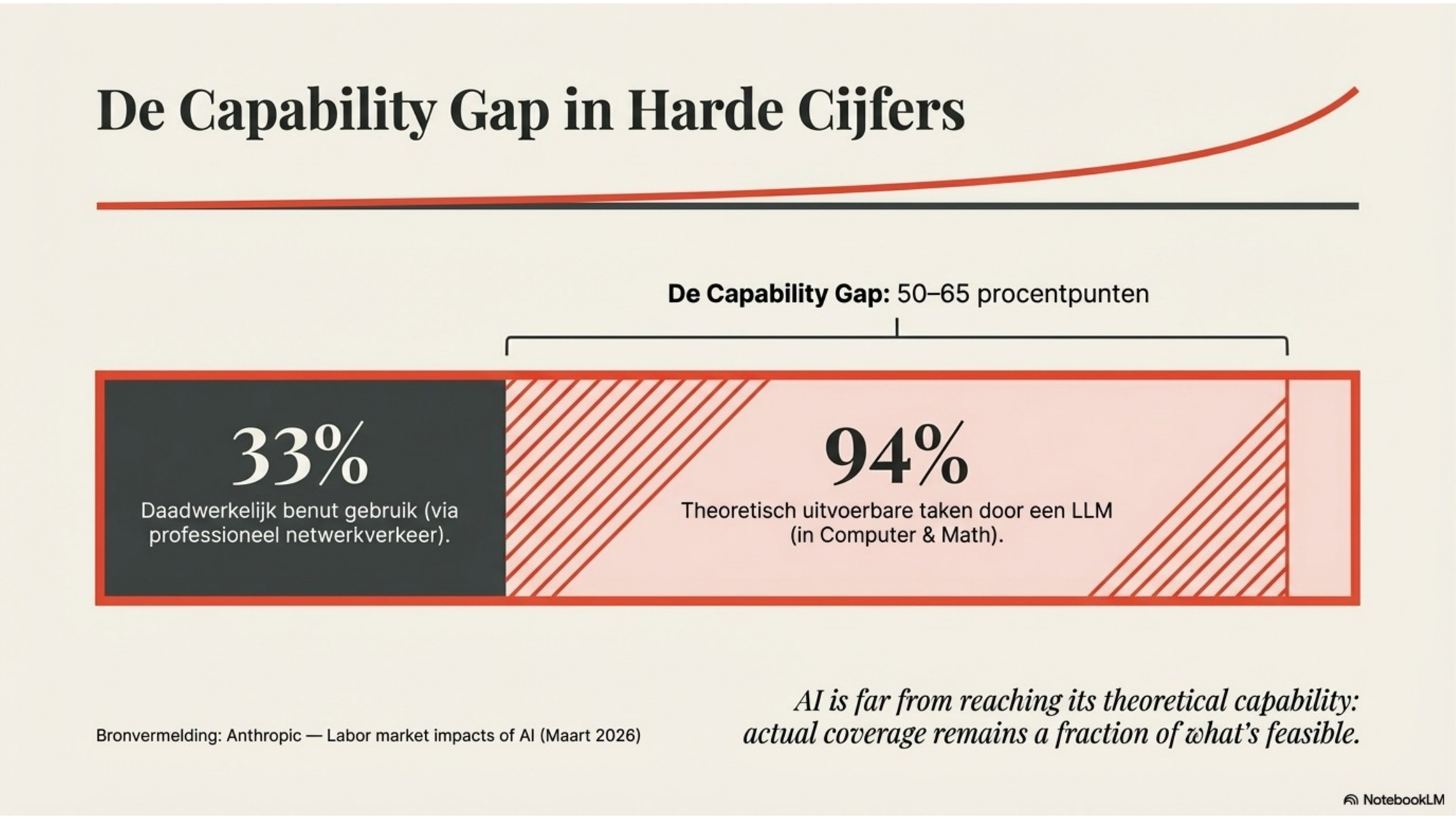

Intussen publiceerde Anthropic in maart 2026 een studie naar de arbeidsmarktimpact van AI.[4] De bevinding die mij het meest treft: in de beroepscategorie Computer & Math is 94 procent van alle taken theoretisch uitvoerbaar door een LLM. Het daadwerkelijke gebruik — gemeten via Anthropic's eigen Claude-verkeer in professionele contexten — dekt slechts 33 procent van die taken. De kloof tussen theoretisch mogelijke en feitelijk benutte AI-capaciteit bedraagt in de meest blootgestelde sectoren consistent 50 tot 65 procentpunten.[5]

"AI is far from reaching its theoretical capability: actual coverage remains a fraction of what's feasible." — Anthropic — Labor market impacts of AI, maart 2026

Dit is de capability gap in harde cijfers. Niet als toekomstscenario, maar als huidig feit. De vraag is: waarom?

II — Tien redenen waarom we niet doen wat we kunnen

De literatuur en de praktijk geven een rijke taxonomie van oorzaken. Ik orden ze in drie clusters — technische barrières, organisatorische barrières en menselijke barrières — die elkaar versterken.

Technische barrières

01 — Verouderde modellen en beperkte toegang. De meeste mensen en organisaties gebruiken AI via interfaces die weken tot maanden achterlopen op de frontier. Gebruikers op gratis lagen hebben toegang tot modellen die al zijn vervangen. Grotere organisaties bevriezen modellen voor compliance-reviews. De gemiddelde medewerker werkt met tools die in capability dichter bij de GPT-4-generatie zitten dan bij de huidige frontier — een factor van meer dan tweehonderd in agentic vermogen.

02 — Legacy-systemen en integratiedrempel. Zestig procent van AI-beslissers noemt integratie met bestaande systemen en compliance-eisen als primaire barrière voor agentic AI. Meer dan 85 procent van technologieleiders verwacht de infrastructuur te moeten aanpassen voordat AI op schaal kan worden ingezet.

03 — Veiligheid, governance en regelgeving. In gereguleerde sectoren — financiën, zorg, overheid — stuiten organisaties op harde juridische grenzen. Het rechtskader loopt ver achter op de technische mogelijkheden. Organisaties wachten op duidelijkheid, en die duidelijkheid komt te laat.

04 — Datakwaliteit en datasilo's. Bijna de helft van onderzochte organisaties noemt onvoldoende toegang tot kwalitatieve eigen data als drempel. AI-systemen zijn zo goed als de data waarop zij werken. Maar data zit verspreid over afdelingen, in incompatibele systemen, ongestructureerd en soms vervuild.

Organisatorische barrières

05 — Pilots die niet schalen. Meer dan 70 procent van AI-pilots haalt de productiefase niet. Van enterprise-grade systemen die worden geëvalueerd, bereikt slechts 5 procent aantoonbare impact op het bedrijfsresultaat. De reden: generieke tools werken goed voor individuen, maar stallen in enterprise-gebruik omdat ze niet leren van organisatiecontext en niet adapteren aan workflows.

06 — Weerstand, macht en gevestigde belangen. Angst voor vervanging, rigide workflows en ingegraven machtsstructuren smoren AI-initiatieven in de kiem, ook in organisaties met geavanceerde tools. AI verandert wie waarde toevoegt en hoe. Dat is een politiek vraagstuk, geen technisch. Het weerstandsmechanisme is menselijk, begrijpelijk en buitengewoon taai.

07 — Verkeerde investering. Meer dan de helft van de AI-budgetten gaat naar sales- en marketingtools, terwijl het grootste rendement wordt gevonden in back-office automatisering. Organisaties investeren waar de verhalen zijn, niet waar de rendementen zijn.

Menselijke barrières

08 — De talent- en vaardigheidskloof. De dominante barrière voor organisationele AI-adoptie is niet budget, niet infrastructuur, niet regelgeving — het is leren. Medewerkers missen het mentale model om AI effectief in te zetten. De eerste stap is bewustwording van wat AI is: geen orakel, geen database, geen rekenmachine, maar een probabilistische voorspellingsmachine die het meest waarschijnlijke vervolg genereert. Wie dat misverstand niet opheft, bouwt op drijfzand.

09 — Het cognitieve probleem van exponentiële groei. De menselijke intuïtie is geoptimaliseerd voor lineaire verandering. Wij onderschatten exponenten. Wie de METR-trendlijn lineair extrapoleerd, denkt: "AI kan nu taken aan van 14 uur, volgend jaar misschien 18 uur." De realiteit bij een verdubbeltijd van vier maanden: over twaalf maanden is de tijdshorizon al vier keer zo groot.

10 — Het Fred-probleem: nieuwe technologie op de oude manier. Het pijnlijkste wat je kunt doen is nieuwe technologie gebruiken op de oude manier. E-mails uitprinten ondanks digitale tools. Handmatige data-entry doen ondanks automatisering. Klagen over werkdruk terwijl je de beschikbare middelen negeert. De meeste medewerkers die nu AI gebruiken, gebruiken het als een snellere zoekmachine. Niet als denkpartner, niet als procesautomatiseerder, niet als strategische copiloot.

III — Twee snelheden, één systeem

Hier ligt het structurele probleem. Er zijn twee systemen die zich ontwikkelen in hetzelfde tijdsbestek, maar met radicaal verschillende snelheden.

Systeem A: de technologische frontier. Dit is de wereld van de frontierlabs. Hier verdubbelt de effectieve capaciteit van AI-agenten elke vier tot zeven maanden. Moderna werkt met nagenoeg volledige adoptie onder kenniswerkers en verwerkt een miljoen AI-conversaties per maand. METR meet hoe de tijdshorizon van autonome agents naar meer dan veertien uur gaat. Dit zijn geen concepten: het zijn producten in de markt, voor wie bereid en in staat is ze te gebruiken.

Systeem B: de gemiddelde organisatie en medewerker. Hier gelden adoptiesnelheden die fundamenteel anders zijn. Rogers' klassieke S-curve van innovatieadoptie geeft normaal gesproken een tijdshorizon van jaren voor de early majority.

Maar er is een complicatie: de S-curve geldt niet voor 'AI' als generieke technologie, maar voor specifieke toepassingen.[6] En die toepassingen worden vervangen voordat de early majority ze goed en wel heeft geadopteerd. ChatGPT bereikte in vijf dagen een miljoen gebruikers, waar elektriciteit dertig jaar nodig had.[7] Maar 'bereiken' is niet hetzelfde als 'transformeren'. Diepe organisationele integratie is een fundamenteel andere uitdaging dan technologisch bereik.

De snelheid van AI-adoptie in de praktijk is lager dan de snelheid van AI-ontwikkeling. Die asymmetrie vergroot de kloof. En die kloof vergroot het risico op schokken.

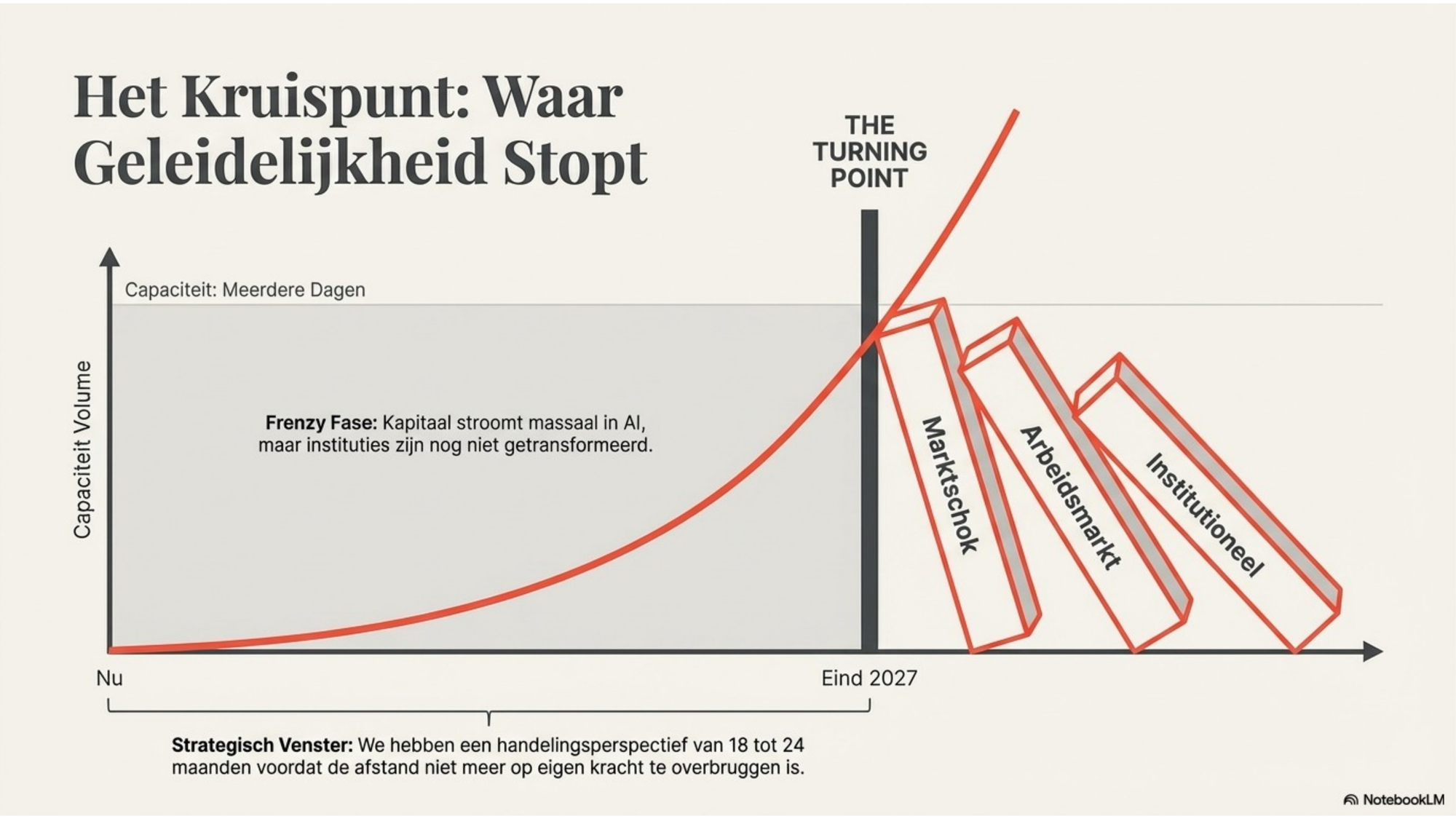

Econome Carlota Pérez heeft beschreven hoe elke grote technologische revolutie verloopt in herkenbare fasen: irruption, frenzy, turning point, en deployment.[8] Wij bevinden ons in de frenzy-fase: financieel kapitaal stroomt massaal naar AI, maar het productiekapitaal — de organisaties, de mensen, de instituties — heeft de transformatie nog niet doorgemaakt. Pérez' historische les is helder: na de frenzy-fase volgt een Turning Point, en dat is zelden comfortabel.

De snelheid van AI-adoptie in de praktijk is lager dan de snelheid van AI-ontwikkeling. Die asymmetrie vergroot de kloof. En die groeiende kloof vergroot het risico op schokken.

IV — Drie soorten schokken

Mijn centrale zorg is deze: als de kloof tussen theoretische capability en praktische adoptie blijft groeien, komt aanpassing niet gradueel maar in schokken. Ik onderscheid drie typen, met een andere tijdshorizon en een andere intensiteit.

Schok type 1: Marktschok

Concurrenten die AI structureel hebben geïntegreerd, worden plotseling meervoudig productiever in specifieke taken. Prijsmodellen in sectoren kantelen. Wie te laat is, kan op kostbasis niet meer concurreren. Dit zijn reeds zichtbare signalen, met name in customer service, softwareontwikkeling en data-analyse. Brynjolfsson et al. (2025) documenteren een daling van zes tot zestien procent in werkgelegenheid in blootgestelde functies — niet via massaontslagen, maar via het niet-vervangen van vacatures.

Schok type 2: Arbeidsmarktschok

Anthropic's arbeidsmarktonderzoek toont al een vroeg waarschuwingssignaal: de instroom van jonge werknemers (22–25 jaar) in hoog-blootgestelde beroepen daalt met gemiddeld 14 procent vergeleken met de pre-ChatGPT periode, en dat effect is net statistisch significant.[9] Tegelijkertijd is er geen significante stijging van werkloosheid in die groep — maar het effect manifesteert zich als 'gehuurde deur dicht': functies worden niet meer ingevuld in plaats van dat mensen worden ontslagen. Computer programmeurs (75 procent blootstelling), customer service medewerkers (70 procent), data-entry medewerkers (67 procent): dit zijn de eerste golven.

Schok type 3: Institutionele schok

Regelgeving, onderwijs en governance lopen zwaar achter op de technologische realiteit. Opleidingen leiden nog steeds op voor beroepen die in hun huidige vorm niet meer bestaan. Juridische kaders zijn niet berekend op autonome AI-agenten. Wanneer de onbalans onhoudbaar wordt, volgen institutionele schokken: acute herziening van curricula, spoedwetgeving, sector-brede reorganisaties. Dit type schok heeft de langste aanlooptijd maar de zwaarste structurele gevolgen.

Ik wil benadrukken: dit zijn geen apocalyptische voorspellingen. Anthropic's eigen data laat zien dat er tot nu toe geen significante stijging is in werkloosheid voor hoog-blootgestelde beroepen. De onderzoekers schrijven terecht dat de impact van AI meer lijkt op de introductie van het internet dan op COVID — gradueel en moeilijk te isoleren van andere factoren, tot het plotseling toch zichtbaar is.

Maar het cruciale verschil met de internet-analogie is de snelheid. Het internet had jaren nodig om sectoren fundamenteel te veranderen. De METR-data suggereert dat AI de grenzen van autonome werkuitvoering elke vier maanden verlegt. Dat is een ander tempo. En bij een verdubbeltijd van vier maanden is 'geleidelijk bijhouden' geen strategie.

Urgentie-indicatie: Als de trendlijn doorzet, heeft een AI-agent eind 2027 een tijdshorizon van meerdere werkdagen. Dat betekent: taken die nu een junior medewerker een week kosten, worden dan door een geautomatiseerd systeem uitgevoerd voor een fractie van de kosten. Organisaties die nu in de exploratiefase zitten — tools proberen, pilots draaien, individuele productiviteitswinsten boeken — hebben bij die trendlijn nog 18 tot 24 maanden voordat de kloof zo groot is dat bijhalen niet meer geleidelijk kan. Dit is geen zekerheid: exponentiële trends kennen breekpunten. Maar wie wacht op zekerheid, heeft te lang gewacht.

V — Waar staat de wereld op de adoptiekaart?

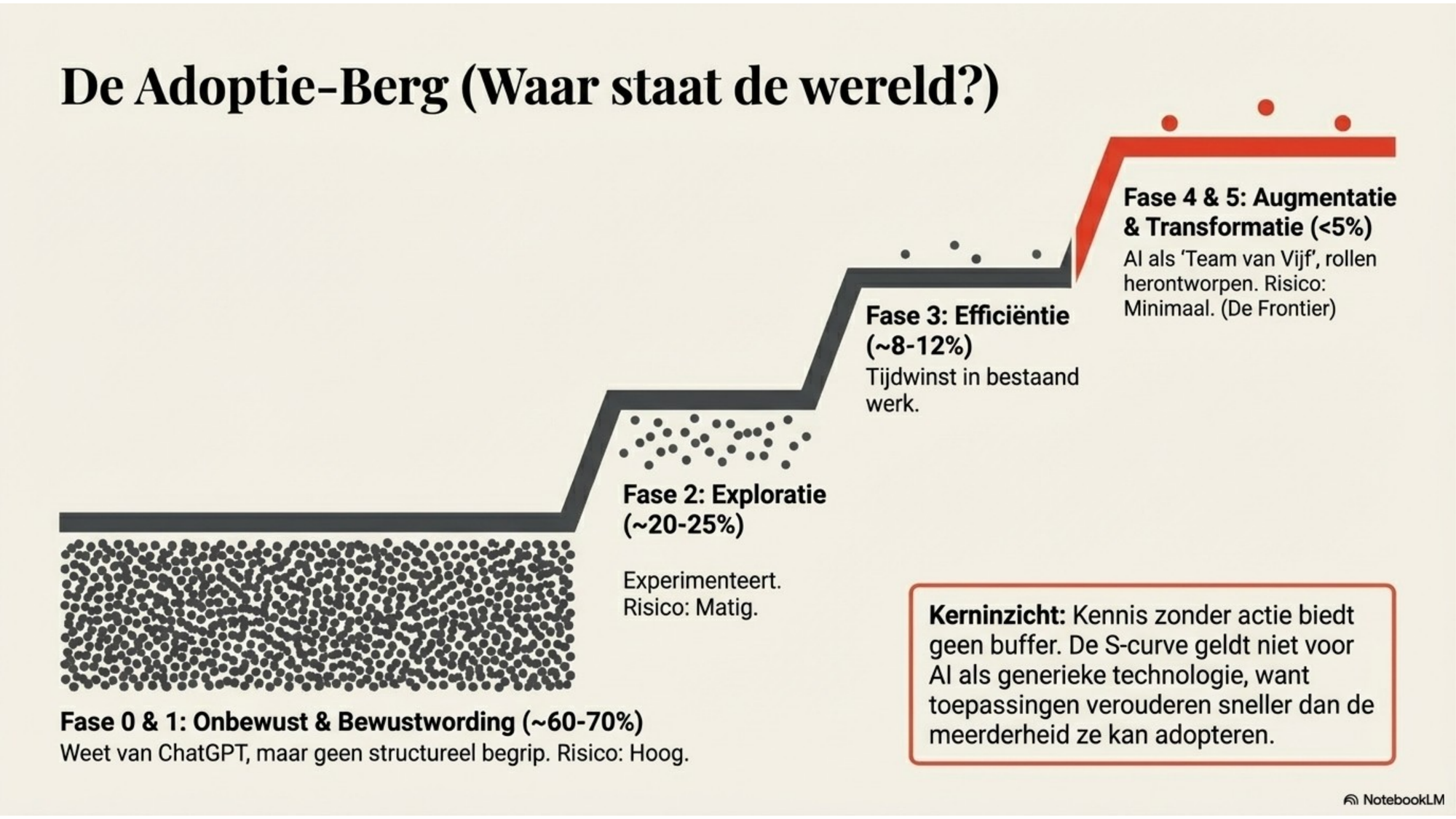

Brice Challamel van Moderna heeft een bruikbaar individueel adoptiemodel ontworpen. De vijf stappen zijn: Bewustwording, Exploratie, Efficiëntie, Augmentatie en Transformatie. Ze beschrijven een psychologische reis van angst naar meesterschap. Wat het model niet zegt — en wat ik er aan toevoeg — is hoe lang je in elke fase kunt blijven gegeven de snelheid van AI-ontwikkeling.

Ik combineer Challamel's stappen met Rogers' adoptiecategorieën en een inschatting van de huidige mondiale populatieverdeling — illustratief, niet empirisch precies, maar in orde van grootte consistent met de beschikbare onderzoeken:

| Fase | Kenmerk | Rogers | ~% wereld | Risico |

|---|---|---|---|---|

| 0. Onbewust | Geen bewust gebruik. Ontkent relevantie of simpelweg niet in aanraking gekomen. | Laggards / buiten systeem | ~25–30% | Hoog. Schok zonder overgang. |

| 1. Bewustwording | Weet dat AI bestaat. Heeft ChatGPT geprobeerd. Begrijpt het nog niet structureel. | Late majority | ~35–40% | Hoog. Kennis zonder actie biedt geen buffer. |

| 2. Exploratie | Experimenteert actief. Begint te begrijpen hoe AI werkt als probabilistische motor. | Early majority (begin) | ~20–25% | Matig. Kans, mits snel. |

| 3. Efficiëntie | Gebruikt AI dagelijks voor versnelling van bestaand werk. Tijdwinst gerealiseerd. | Early majority (gevorderd) | ~8–12% | Laag voor nu. Niet de eindbestemming. |

| 4. Augmentatie | Doet dingen die voorheen niet mogelijk waren. AI als denkpartner. 'Team van Vijf'. | Early adopters | ~3–5% | Laag. Leert sneller dan de rest. |

| 5. Transformatie | Rol herontworpen rond AI. Organisatie opereert fundamenteel anders. | Innovators | <1% | Minimaal. Creëert de volgende frontier. |

Meer dan vijftig procent van de wereldbevolking staat in fase 0 of 1. Minder dan vijf procent heeft augmentatie of transformatie bereikt. En het kritische inzicht: de AI-frontier beweegt zichzelf steeds verder weg van de rest. Niet doordat de rest stilstaat, maar doordat de frontier versnelt. Moderna met zijn miljoen AI-conversaties per maand en nagenoeg volledige medewerkeradoptie, de frontierlabs die AI inzetten om zichzelf sneller te verbeteren — zij opereren in een fundamenteel andere werkelijkheid dan de late majority die nu begint te begrijpen wat ChatGPT is.

Dit is wat ik de divergentie van realiteiten noem. En het is de reden waarom gesprekken over AI zo lastig zijn. De early adopter die vertelt over autonome coding-agents die veertien uur taken uitvoeren, en de medewerker die voor het eerst een prompt schrijft, leven in dezelfde kalender maar in radicaal verschillende AI-werkelijkheden.

VI — Een tweedimensionaal kader: urgentie én rijpheid

Het adoptiemodel is uitstekend voor communicatie met mensen die aan het begin van hun reis staan. Maar het mist een dimensie: tijdsdruk. Wie zich in fase 2 (exploratie) bevindt en comfortabel aan het experimenteren is, heeft een fundamenteel andere situatie als die fase vijf jaar duurt dan als die fase twee jaar duurt.

Ik combineer het adoptiemodel met een tweede as: de tijdshorizon voor relevantie. Dat levert vier posities op:

A — Kwetsbaar (laag rijp / hoge urgentie). Fase 0–1. Nauwelijks gebruik. De organisatie denkt dat AI 'haar sector niet treft'. Existentieel risico binnen twee tot drie jaar. Eerste prioriteit: bewustwording op bestuursniveau, gevolgd door radicale versnelling van adoptie.

B — Op schema (matig rijp / matige urgentie). Fase 2–3. Actief experimenteren, pilots draaien, individuele productiviteitswinsten zichtbaar. Maar nog geen structurele integratie. Houdbaar voor twaalf tot vierentwintig maanden. Kritiek: versnelling van pilot-naar-productie, investering in governance en data-infrastructuur nu.

C — Vals comfort (schijnadoptie / echte urgentie). Veel pilots, veel enthousiasme, maar geen aantoonbare bedrijfsimpact. Vijf procent van enterprise-pilots haalt P&L-impact — de rest leeft in kwadrant C. Gevaarlijkste positie: men denkt te transformeren maar staat stil. Diagnose: zijn de tools workflow-geïntegreerd en lerend? Zo niet: herstart met een andere aanpak.

D — Voorlopig veilig (hoog rijp / lage urgentie). Fase 4–5. AI structureel geïntegreerd, concrete businesswaarde aantoonbaar, organisatie leert van gebruik. Continueer en verdiep. Maar: de frontier versnelt ook. Complacency is gevaar.

Mijn inschatting: het grootste deel van de Nederlandse organisaties bevindt zich in positie A of C. Positie A zijn de sectoren die AI nog niet serieus nemen. Positie C zijn de organisaties die AI serieus nemen maar het verkeerd aanpakken.

VII — Hoe versnel je adoptie — en welke taal werkt?

Het individu: van angst naar meesterschap

De cruciale eerste stap is bewustwording van wat AI is: geen orakel, geen database, geen rekenmachine — maar een probabilistische voorspellingsmachine die het meest waarschijnlijke vervolg genereert. Wie dat begrijpt, verliest de magie en de angst tegelijk, en begint effectief te gebruiken.

Moderna's aanpak is hier instructief: geef iedereen toegang, creëer een veilige speelomgeving zonder productiedruk, beloon de populairste ideeën, en bouw van daar de individuele reis. De sleutel is: spelen vóór presteren. Challamel: "Spelen is hoe zoogdieren leren."

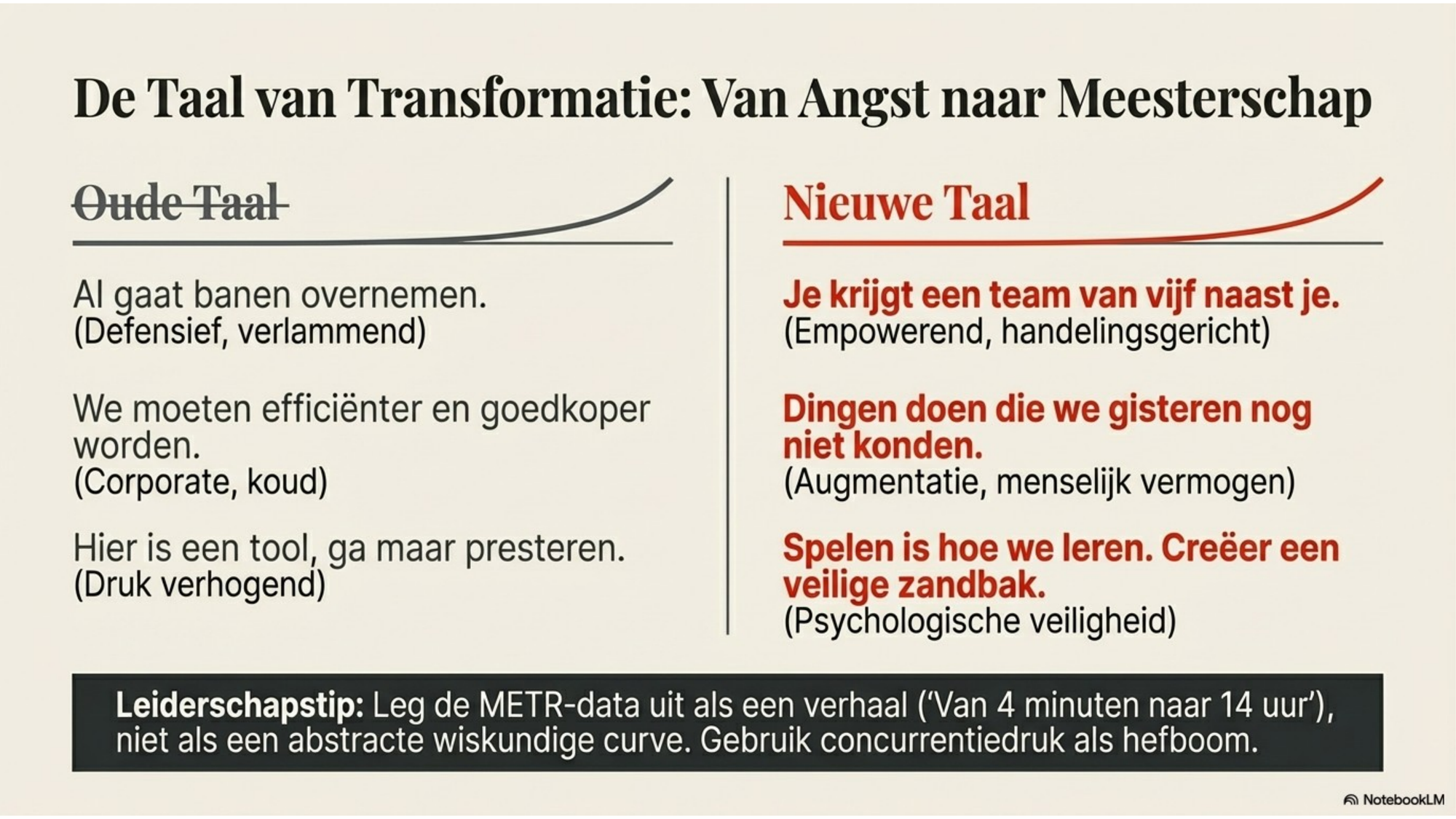

De taal die werkt bij de early majority: niet "AI gaat jouw baan overnemen" (defensief, verlammend) maar "AI geeft je een team van vijf naast je" (empowerend, handelingsgericht). Niet "efficiëntie" (koud, corporate) maar "dingen doen die je gisteren nog niet kon" (augmentatie, menselijk vermogen).

De organisatie: architectuur vóór tools

MIT NANDA-onderzoek is ondubbelzinnig: de dominante barrière voor organisationele AI-adoptie is niet budget, niet infrastructuur, niet regelgeving — het is leren.[10] AI-systemen die niet leren van organisatiecontext en niet adapteren aan workflows, blijven generieke tools die individuele productiviteit verhogen maar geen organisationele transformatie bewerkstelligen.

De aanbeveling: investeer eerst in de architectuur voor leren. Unified data-platforms, workflow-specifieke AI-integratie, feedbackloops die AI-systemen verbeteren met gebruik. En: decentraliseer autoriteit — lijnmanagers moeten AI kunnen adopteren zonder centrale AI-labs als bottleneck.

Moderna's vier transformatieronden zijn sequentieel en niet overslaan: (1) Readiness — is de organisatie er klaar voor? (2) Digital Foundations — de technische infrastructuur. (3) AI Adoption — daadwerkelijk gebruik opbouwen. (4) Ways of Working — werk herontwerpen rond AI. Wie stap 3 overslaat omdat de infrastructuur nog niet op orde is, bouwt op drijfzand.

De taal van urgentie

De grootste communicatie-uitdaging is de exponentiële curve overbrengen aan mensen wier intuïtie lineair is. Daarvoor gebruik ik een concreet ankerpunt: het METR-getal. Niet als technische statistiek, maar als verhaal.

"In 2023 kon AI een taak aan die een ervaren softwareontwikkelaar vier minuten kostte. Begin 2026 is dat veertien uur. Bij een verdubbeltijd van vier maanden is dat over twaalf maanden zes tot acht keer zoveel."

Dat verhaal is concreet, verifieerbaar, en maakt de abstracte exponentiële curve tastbaar in de tijdshorizon van een bestuurder die denkt in kwartalen.

De tweede taal die werkt: de concurrentiedynamiek. Niet "AI is interessant" maar "jouw concurrent heeft dit al". Organisaties bewegen niet op abstractie, zij bewegen op dreiging en kans.

Afsluitend — De kern in vijf punten

Een. De capability gap is al groot. Wat AI nu kan in de handen van de best opgeleide gebruikers met toegang tot frontier-modellen, is fundamenteel anders dan wat de gemiddelde medewerker of organisatie nu doet. De Anthropic-data — 33 procent daadwerkelijk gebruik versus 94 procent theoretisch mogelijk bij Computer & Math — is het harde bewijs.[4]

Twee. Die kloof groeit. AI-capabilities verdubbelen elke vier tot zeven maanden in effectiviteit op agentic taken (METR).[1][2] Adoptietrajecten duren jaren. De asymmetrie is structureel.

Drie. Dit leidt tot schokken. Niet universeel en niet gelijktijdig, maar sectorspecifiek en in golven. Marktschokken, arbeidsmarktschokken en institutionele schokken — elk met een andere tijdshorizon.

Vier. De schokken zijn te anticiperen en deels te vermijden. Organisaties die nu bewust in transformatie investeren — niet in pilots, maar in structurele workflow-integratie en menselijke omscholing — bouwen een buffer. Het venster is niet gesloten, maar het sluit.

Vijf. Menselijk vermogen wordt schaarser, niet overbodig. De organisaties en mensen die overleven en floreren in de AI-transitie, zijn niet degenen die het hardst tegen AI vechten, noch degenen die het volledigst door AI worden vervangen. Het zijn degenen die de kloof tussen theorie en praktijk het beste kunnen overbruggen — voor zichzelf en voor anderen.

De vraag is niet of AI jouw organisatie raakt. De vraag is of je de schok vóór bent, of de schok jou.

Dit is een conceptgedachtenspinsel, geen eindoordeel. Ik ga hier zelf op kauwen en gebruik het als startpunt voor gesprekken om het geheel verder aan te scherpen.

Bronnen & noten

[1] Kwa, T. & West, A. et al., "Measuring AI Ability to Complete Long Tasks", METR, maart 2025. De tijdshorizon (p50) heeft over de periode 2019–2025 een verdubbeltijd van ~7 maanden. metr.org/blog/2025-03-19-measuring-ai-ability-to-complete-long-tasks/

[2] METR, "Time Horizon 1.1", januari 2026. Post-2023 verdubbeltijd onder TH1.1-methode: 131 dagen. metr.org/blog/2026-1-29-time-horizon-1-1/

[3] METR, gepubliceerd 20 februari 2026. Claude Opus 4.6 p50-tijdshorizon: 14,5 uur (95%-betrouwbaarheidsinterval: 6 tot 98 uur). METR benoemt zelf dat de taakset nadert aan saturatie bij langere tijdshorizons; de brede CI reflecteert die onzekerheid. Het YAML-benchmarkbestand toont een point estimate van 718 minuten (~12 uur) onder TH1.1-methodologie; het verschil met de officieel gepubliceerde 14,5 uur wordt verklaard door methodologische aanpassingen en de keuze van modelversie. Ik gebruik 'circa 12 tot 15 uur' als voorzichtige formulering.

[4] Massenkoff, M. & McCrory, P., "Labor market impacts of AI: A new measure and early evidence", Anthropic, 5 maart 2026. anthropic.com/research/labor-market-impacts

[5] Dev.to / Anthropic synthese: de kloof tussen theoretische en geobserveerde blootstelling bedraagt consistent 50 tot 65 procentpunten. De lineaire regressie geeft: observed ≈ 0,24 × theoretical (r = 0,92, p < 0,001).

[6] "On misinterpreting the diffusion of innovations curve", Only Dead Fish, januari 2025. Kerninzicht: de diffusiecurve geldt voor specifieke toepassingen, niet voor generieke technologieën.

[7] Machulla, P., "The Compressed Diffusion Curve", Medium, 2025. ChatGPT bereikte 1 miljoen gebruikers in 5 dagen; elektriciteit deed er ~30 jaar over.

[8] Pérez, C., Technological Revolutions and Financial Capital: The Dynamics of Bubbles and Golden Ages, Edward Elgar, 2002. Vier fasen: Irruption, Frenzy, Turning Point, Deployment/Golden Age.

[9] Massenkoff & McCrory, op. cit., Figuur 7. Daling van 14 procent in job-finding rate voor werknemers 22–25 jaar in hoog-blootgestelde beroepen, post-ChatGPT; net statistisch significant (pooled: -14,3, SE 7,2). Geen significante stijging in werkloosheid gevonden.

[10] MIT NANDA Initiative, "The GenAI Divide: State of AI in Business 2025", 2025. Kernconclusie: "The core barrier to scaling is not infrastructure, regulation, or talent. It is learning." 95 procent van enterprise AI-pilots bereikt geen aantoonbare P&L-impact.

[11] Rogers, E.M., Diffusion of Innovations, Free Press, eerste druk 1962. Vijf categorieën: Innovators (2,5%), Early Adopters (13,5%), Early Majority (34%), Late Majority (34%), Laggards (16%).

[12] Challamel, B., "De AI-Transformatie Blauwdruk van Moderna", NotebookLM-presentatie, 2025/2026. Vijf stappen: Bewustwording, Exploratie, Efficiëntie, Augmentatie, Transformatie. Vier organisatieronden: Readiness, Digital Foundations, AI Adoption, Ways of Working.

Jeroen Teunisse · Maart 2026 · Conceptversie